Thitiporn - stock.adobe.com

Multi-Cloud-Backup verstehen und richtig umsetzen

Daten liegen oft in mehreren Clouds, SaaS-Plattformen und Rechenzentren. Multi-Cloud-Backups sorgen dafür, dass Sicherungen unabhängig von einzelnen Anbietern verfügbar bleiben.

Cloud-Infrastrukturen bilden heute das Fundament vieler IT-Architekturen. Unternehmen betreiben oft Anwendungen parallel in mehreren Public-Cloud-Umgebungen, kombinieren Cloud-Dienste mit eigenen Rechenzentren oder nutzen zusätzlich SaaS-Plattformen. Diese Entwicklung führt zu einer grundlegenden Veränderung der Datensicherung. Klassische Backup-Strategien, die auf eine einzelne Plattform oder ein einzelnes Rechenzentrum ausgelegt sind, reichen in solchen Umgebungen nicht mehr aus. Multi-Cloud-Backup beschreibt daher eine Architektur, bei der Sicherungskopien von Daten bewusst über mehrere Cloud Service Provider (CSP) verteilt werden. Typische Zielplattformen sind Amazon Web Services, Microsoft Azure oder Google Cloud, ergänzt durch zusätzliche Objekt-Storage oder lokale Backup-Repositories. Multi-Cloud-Backup kann aber auch bedeuten, Workloads aus verschiedenen Clouds zu sichern. Unser Beitrag bezieht sich auf das erstgenannte Szenario.

Was steckt hinter einem Backup in Multi-Cloud-Umgebungen?

Der zentrale Gedanke besteht darin, Daten unabhängig von der Infrastruktur zu sichern, auf der sie ursprünglich erzeugt wurden. Anwendungen können in verschiedenen Clouds laufen, Datenbanken in einer Plattform liegen und Archivdaten in einer anderen gespeichert werden. Eine Multi-Cloud-Backup-Strategie sorgt dafür, dass Sicherungskopien über diese Plattformgrenzen hinweg repliziert oder verschoben werden. Dadurch entsteht eine redundante Datensicherung, die nicht von der Verfügbarkeit eines einzelnen Cloud Service Providers abhängt.

Die zunehmende Nutzung mehrerer Cloud-Plattformen hat in vielen Organisationen zu einer Situation geführt, in der Daten, Anwendungen und Dienste auf unterschiedliche Infrastrukturmodelle verteilt sind. Produktionssysteme laufen teilweise weiterhin im eigenen Rechenzentrum, Entwicklungsumgebungen befinden sich in einer Public Cloud, während Collaboration-Plattformen vollständig als SaaS (Software as a Service) betrieben werden. Backup-Konzepte müssen diese heterogene Landschaft berücksichtigen und Daten aus allen diesen Quellen zuverlässig sichern. Multi-Cloud-Backups entwickeln sich daher von einer optionalen Strategie zu einem zentralen Bestandteil moderner IT-Resilienz.

Architekturprinzipien moderner Multi-Cloud-Backups

In Multi-Cloud-Umgebungen übernehmen Backups eine doppelte Rolle. Sie dienen einerseits der klassischen Wiederherstellung nach Datenverlust, andererseits bilden sie einen Bestandteil der gesamten Sicherheitsarchitektur. Cloud Provider replizieren Daten in ihren Rechenzentren zwar automatisch, diese Replikation ersetzt jedoch kein Backup. Wird eine Datei gelöscht oder durch Malware verschlüsselt, betrifft die Änderung auch die replizierten Daten. Ein unabhängiges Backup bleibt daher weiterhin erforderlich.

Eine Multi-Cloud-Strategie nutzt mehrere Ebenen der Datensicherung. Häufig liegt eine erste Sicherungskopie in derselben Cloud-Region wie die Produktionsdaten. Diese Kopie erlaubt eine schnelle Wiederherstellung ohne Datenübertragung zwischen Plattformen. Eine zweite Sicherung wird anschließend in eine andere Cloud-Region oder zu einem anderen Provider repliziert. Dadurch bleibt eine externe Wiederherstellungsquelle erhalten, selbst wenn eine gesamte Plattform ausfällt oder kompromittiert wird.

In vielen Architekturen kommt zusätzlich Objekt-Storage als Backup-Ziel zum Einsatz. Dienste wie Amazon S3, Azure Blob Storage oder Google Cloud Storage bieten praktisch unbegrenzte Kapazität und unterstützen Funktionen wie Versionierung, Archiv-Speicherklassen und Lebenszyklusregeln. Backup-Software kann Daten automatisiert zwischen unterschiedlichen Speicherklassen verschieben, wodurch sich Kosten und Performance optimieren lassen.

Das Tier-Modell bei der Datensicherung berücksichtigen

Ein weiterer zentraler Bestandteil aktueller Backup-Architekturen ist die mehrstufige Speicherung von Backup-Daten. Viele Systeme verwenden ein Tier-Modell, das verschiedene Speicherklassen kombiniert. Die erste Ebene besteht aus einem schnellen Performance-Tier. Hier liegen aktuelle Sicherungskopien auf lokalen Datenträgern oder schnellen Storage-Systemen, um eine möglichst schnelle Wiederherstellung zuzulassen. Diese Ebene dient als primäre Wiederherstellungsquelle für kurzfristige Restore-Vorgänge.

Eine zweite Ebene bildet das Capacity-Tier. Hier werden ältere Sicherungskopien automatisiert in Cloud-Object-Speicher verschoben. Dieses Storage ist deutlich skalierbarer und ermöglicht langfristige Aufbewahrung ohne die Kapazitätsgrenzen lokaler Storage-Systeme. Da Object Storage in der Regel günstiger als lokales Hochleistungs-Storage ist, eignet sich diese Ebene besonders für mittel- und langfristige Aufbewahrungsfristen.

Eine dritte Ebene stellt das Archive-Tier dar. In diesem Bereich werden Daten in besonders kostengünstigen Archiv-Speicherklassen abgelegt. Diese Speicher eignen sich für Daten, die selten benötigt werden, aber über viele Jahre aufbewahrt werden müssen. Cloud-Plattformen stellen hierfür spezielle Archivservices bereit. Backup-Software kann automatisiert festlegen, wann Daten aus dem Capacity-Tier in Archivspeicher verschoben werden.

Weiterentwicklung der klassischen Backup-Regeln: Schutz vor Ransomware

Viele Backup-Strategien orientieren sich noch immer an der bekannten 3-2-1-Regel. Sie verlangt drei Kopien von Daten auf zwei unterschiedlichen Speichermedien sowie eine Kopie außerhalb des Produktionsstandorts. In Cloud-Umgebungen wird diese Regel erweitert. Neue Datensicherungsstrategien sprechen häufig von der 3-2-1-1-0-Regel.

Die zusätzliche Eins beschreibt eine unveränderliche Sicherungskopie. Solche Backups nutzen WORM-Mechanismen oder Object-Lock-Funktionen, die das Löschen oder Überschreiben von Daten während einer definierten Aufbewahrungszeit verhindern. Die Null am Ende steht für regelmäßige Integritätsprüfungen der Backups, die sicherstellen sollen, dass Sicherungskopien tatsächlich wiederherstellbar bleiben.

Immutable Storage bildet deshalb eine der wichtigsten Komponenten von Multi-Cloud-Backups. Viele Cloud Provider unterstützen diese Funktion direkt im Objekt-Storage. Backup-Software kann Daten mit einer festen Aufbewahrungszeit speichern, sodass weder Administratoren noch Angreifer Änderungen vornehmen können. Diese Technologie spielt eine zentrale Rolle beim Schutz vor Ransomware.

Neben der Unveränderlichkeit von Backups existieren weitere wichtige Sicherheitskonzepte, die häufig miteinander verwechselt werden. Immutability beschreibt ausschließlich den Schutz vor Änderungen oder Löschvorgängen an gespeicherten Daten. Hardening bezieht sich dagegen auf die Absicherung der Backup-Infrastruktur selbst. Hierbei werden potenzielle Angriffsvektoren identifiziert und so weit wie möglich reduziert. Dazu gehören eingeschränkte Administratorrechte, abgeschottete Management-Netzwerke oder besonders gehärtete Linux-Systeme für Backup-Repositories.

Ein drittes Konzept stellt das Air Gap dar. Dabei handelt es sich um eine physische oder logische Trennung von Backup-Daten vom Produktionsnetzwerk. Klassische Air-Gap-Systeme speichern Sicherungen auf Medien, die nicht dauerhaft mit dem Netzwerk verbunden sind. Diese Trennung verhindert, dass Angreifer Backup-Daten direkt manipulieren können.

Die Kombination dieser drei Konzepte bietet ein hohes Maß an Sicherheit. Unveränderliche Backups schützen Daten vor Manipulation. Gehärtete Systeme reduzieren Angriffsmöglichkeiten auf die Backup-Infrastruktur. Air-Gap-Kopien sorgen dafür, dass selbst bei einem vollständigen Systemkompromiss noch eine unabhängige Sicherung existiert.

Sicherheitsanforderungen in Multi-Cloud-Umgebungen

Die wachsende Anzahl von Cloud-Plattformen erhöht auch die Angriffsfläche. Cyberangriffe zielen häufig darauf ab, Backup-Systeme zu kompromittieren oder Sicherungskopien zu löschen. Angreifer versuchen zunächst administrative Zugänge zu erlangen und anschließend Sicherungsdaten zu entfernen, bevor eigentliche Verschlüsselungsangriffe stattfinden.

Ein effektives Multi-Cloud-Backup berücksichtigt deshalb mehrere Sicherheitsprinzipien. Dazu gehört die Trennung von Produktions- und Backup-Konten. In Public-Cloud-Umgebungen lassen sich Backups in separaten Accounts oder Projekten speichern. Selbst wenn ein Produktionssystem kompromittiert wird, bleibt der Zugriff auf die Backup-Infrastruktur eingeschränkt.

Ein weiteres Prinzip ist das Least-Privilege-Modell. Benutzer und Dienste erhalten nur jene Rechte, die sie für ihre Aufgaben benötigen. Identitäts- und Zugriffssysteme (IAM) der Cloud Provider erlauben eine feingranulare Steuerung dieser Berechtigungen. Multifaktor-Authentifizierung (MFA) und rollenbasierte Zugriffskontrolle (RBAC) reduzieren zusätzlich das Risiko unbefugter Zugriffe.

Verschlüsselung spielt ebenfalls eine zentrale Rolle. Daten werden sowohl während der Übertragung als auch im Speicher verschlüsselt. Cloud-Plattformen stellen dafür eigene Schlüsselmanagementsysteme bereit. Unternehmen können eigene Schlüssel verwalten oder die Schlüssel der Cloud Service Provider nutzen, um Backup-Daten vor unbefugtem Zugriff zu schützen.

Zusätzlich gewinnen Monitoring und Angriffserkennung zunehmend an Bedeutung. Backup-Systeme überwachen kontinuierlich die Infrastruktur und analysieren ungewöhnliche Aktivitäten. Auffällige Veränderungen der Systemlast, ungewöhnliche Datenänderungen oder unerwartete Wachstumsraten von virtuellen Festplatten können Hinweise auf laufende Verschlüsselungsangriffe liefern. Backup-Plattformen können entsprechende Alarme auslösen und Administratoren frühzeitig warnen.

Auch Audit-Protokolle spielen eine wichtige Rolle. Sie dokumentieren Änderungen an Backup-Konfigurationen, Zugriffen und Wiederherstellungsoperationen. Im Falle eines Sicherheitsvorfalls lässt sich nachvollziehen, welche Aktionen durchgeführt wurden und welche Systeme betroffen sind.

Nutzung von Backups über die reine Wiederherstellung hinaus

Backups erfüllen in IT-Umgebungen nicht ausschließlich den Zweck der Datenwiederherstellung. Viele Organisationen nutzen Sicherungskopien aktiv für weitere Prozesse innerhalb der IT. Ein häufiges Szenario ist die Bereitstellung von Entwicklungs- oder Testumgebungen. Kopien produktiver Daten können in isolierten Netzwerken gestartet werden, um neue Softwareversionen oder Konfigurationsänderungen zu testen. Dadurch lassen sich Fehler erkennen, bevor Änderungen in Produktionssysteme übernommen werden.

Auch Sicherheitsanalysen profitieren von solchen Kopien. Sicherheitsabteilungen können Backup-Daten in separaten Umgebungen untersuchen, ohne die Produktionssysteme zu beeinflussen. Verdächtige Dateien oder mögliche Malware lassen sich analysieren, ohne Risiken für den laufenden Betrieb zu erzeugen. Ein weiteres Einsatzgebiet ist das Patch-Testing. Administratoren können Updates zunächst auf Backup-basierten Testsystemen installieren und deren Verhalten beobachten. Erst wenn die Stabilität bestätigt wurde, erfolgt die Installation in der Produktionsumgebung.

Herausforderungen bei der Umsetzung

Der Einsatz mehrerer Cloud Provider bringt neben Vorteilen auch neue Herausforderungen. Ein häufiges Problem ist die fragmentierte Verwaltung von Backups. Viele Plattformen stellen eigene Sicherungsfunktionen bereit, die jedoch nur innerhalb der jeweiligen Cloud funktionieren. Unternehmen müssen dann mehrere Tools parallel betreiben, was die Verwaltung komplexer und fehleranfälliger macht.

Ein weiteres Thema betrifft Kostenkontrolle und Datenbewegung zwischen Clouds. Jede Plattform verwendet eigene Preismodelle für Speicher, Datenübertragung und API-Zugriffe. Ohne automatisierte Steuerung kann die Sicherung großer Datenmengen schnell teuer werden. Multi-Cloud-Backup-Lösungen versuchen daher, Daten intelligent zwischen Speicherklassen zu verschieben und Archiv-Storage für selten benötigte Backups zu nutzen.

Auch regulatorische Anforderungen spielen eine wichtige Rolle. Viele Branchen müssen Daten in bestimmten Regionen speichern oder definierte Aufbewahrungsfristen einhalten. Multi-Cloud-Architekturen ermöglichen es, Backup-Daten gezielt in bestimmten Regionen abzulegen und so Compliance-Vorgaben zu erfüllen.

Ein weiteres Problem besteht darin, dass Daten in einer Vielzahl unterschiedlicher Plattformen entstehen. Neben klassischen Servern und virtuellen Maschinen werden Daten auch in SaaS-Anwendungen oder Containerplattformen erzeugt. Backup-Lösungen müssen diese unterschiedlichen Datenquellen integrieren können, um eine vollständige Datensicherung zu gewährleisten.

Sicherung von Cloud-nativen Workloads

Cloud-native Anwendungen unterscheiden sich stark von klassischen IT-Systemen. Viele Plattformen nutzen dynamische Ressourcen, automatisierte Skalierung und Containertechnologien. Backup-Strategien müssen diese Besonderheiten berücksichtigen. Eine wichtige Rolle spielen Snapshots. Cloud-Plattformen ermöglichen die Erstellung konsistenter Snapshots von virtuellen Maschinen (VMs) oder Daten-Volumes. Diese Snapshots bilden häufig die Grundlage für nachgelagerte Backups und dienen so als Backup-Quelle oder Transportmechanismus. Backup-Software kann diese Snapshots automatisiert erstellen, in Backup-Dateien umwandeln und anschließend in Object Storage übertragen.

Darüber hinaus unterstützen viele Plattformen Cross-Region- und Cross-Account-Replikation. Sicherungskopien werden automatisch in andere Regionen oder Cloud-Konten kopiert, um zusätzliche Sicherheitsebenen zu schaffen. Solche Mechanismen erhöhen die Ausfallsicherheit und reduzieren das Risiko eines vollständigen Datenverlusts. Auch automatisierte Richtlinien spielen eine zentrale Rolle. Backup-Systeme definieren Regeln für Snapshot-Erstellung, Backup-Frequenz, Aufbewahrungsfristen und Datenmigration zwischen Speicherklassen. Dadurch lassen sich Backup-Prozesse weitgehend automatisieren und konsistent über mehrere Plattformen hinweg steuern.

Schutz von SaaS-Daten

Ein häufig unterschätzter Bereich moderner Backup-Strategien betrifft SaaS-Anwendungen. Viele Unternehmen nutzen Plattformen wie Microsoft 365 oder Salesforce für geschäftskritische Prozesse. SaaS-Provider sichern jedoch in erster Linie ihre Infrastruktur und gewährleisten die Verfügbarkeit der Plattform. Die Verantwortung für den Schutz der eigentlichen Daten liegt weiterhin beim Kunden. Werden Dateien versehentlich gelöscht, durch Benutzerfehler verändert oder durch Malware manipuliert, stehen oft nur begrenzte Wiederherstellungsoptionen zur Verfügung. Dedizierte Backup-Lösungen für SaaS-Plattformen erstellen daher zusätzliche Sicherungskopien von Postfächern, Dokumentenbibliotheken oder Collaboration-Daten. Diese Backups können in unabhängigen Speichern abgelegt werden und ermöglichen granularere Wiederherstellungsoptionen.

Datensicherung für Container- und Kubernetes-Plattformen

Anwendungen bestehen häufig aus mehreren Microservices und nutzen unterschiedliche Datenspeicher innerhalb eines Kubernetes-Clusters. Backup-Lösungen müssen daher nicht nur einzelne Container sichern, sondern komplette Anwendungen mit ihren Daten, Konfigurationen und Abhängigkeiten. Kubernetes-Backup-Systeme arbeiten applikationszentriert und erfassen sowohl Datenbanken als auch Konfigurationsdateien und Netzwerkdefinitionen. Diese Backups ermöglichen die Wiederherstellung kompletter Anwendungen oder ganzer Cluster. Gleichzeitig unterstützen sie Migrationen zwischen unterschiedlichen Cloud-Plattformen oder Kubernetes-Distributionen. Viele Lösungen nutzen Kubernetes APIs und CSI-Snapshots.

Typische Lösungsansätze und Werkzeuge

Zur Umsetzung solcher Architekturen stehen unterschiedliche Lösungsansätze zur Verfügung. Einige Werkzeuge konzentrieren sich auf die Verwaltung mehrerer Cloud-Speicher und ermöglichen direkte Datenübertragungen zwischen Plattformen. Dienste wie MultCloud bündeln verschiedene Cloud-Konten in einer Oberfläche und unterstützen Cloud-zu-Cloud-Transfers, Synchronisation oder automatisierte Backups zwischen unterschiedlichen Speicheranbietern.

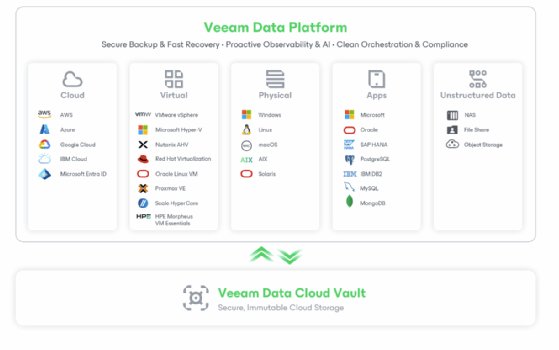

Unternehmenslösungen gehen deutlich weiter und integrieren Backup-Management, Automatisierung und Wiederherstellung in eine zentrale Plattform. Produkte wie die Veeam Data Platform verfolgen diesen Ansatz. Solche Systeme sichern virtuelle Maschinen, Datenbanken, Cloud-Workloads oder SaaS-Dienste und können Backups gleichzeitig in mehreren Cloud-Speichern ablegen. Sie unterstützen Funktionen wie automatisierte Snapshot-Erstellung, Cross-Region-Replikation oder unveränderliche Backups im Objekt-Storage.

Auch Cloud-native Datensicherungsplattformen entwickeln sich weiter. Anbieter wie Eon setzen verstärkt auf automatisierte Backup-Strategien für Cloud-Datenbanken und Analysesysteme. Diese Lösungen integrieren Backup-Funktionen direkt in Cloud-Workloads und bieten Analyse- oder Wiederherstellungsfunktionen für große Datensätze.

Multi-Cloud-Backup als Bestandteil der Resilienzstrategie

Die Bedeutung von Multi-Cloud-Backups wächst mit der zunehmenden Verlagerung von Workloads in die Cloud. Unternehmen nutzen mehrere Plattformen für unterschiedliche Aufgaben. Entwicklungsumgebungen laufen in einer Cloud, Produktionssysteme in einer anderen und Analyseplattformen wiederum auf einer dritten Infrastruktur. Backup-Strategien müssen diese Vielfalt berücksichtigen. Eine durchdachte Multi-Cloud-Backup-Architektur kombiniert mehrere Sicherheitsmechanismen. Dazu gehören redundante Datenspeicherung über mehrere Plattformen, unveränderliche Backups, strenge Zugriffskontrollen sowie regelmäßige Tests der Wiederherstellung. Nur wenn Sicherungskopien tatsächlich wiederherstellbar bleiben, erfüllen sie ihren Zweck.

Die Entwicklung zeigt zudem eine zunehmende Automatisierung. Backup-Systeme analysieren Workloads, erstellen Richtlinien für Datensicherung und verschieben Backup-Daten automatisch zwischen Cloud-Speichern oder Archiv-Systemen. Dadurch lassen sich Kosten reduzieren und gleichzeitig die Ausfallsicherheit erhöhen. Multi-Cloud-Backups entwickeln sich damit zu einem zentralen Baustein aktueller IT-Strategien. Sie verbinden Datensicherung, Sicherheitsarchitektur und Cloud-Management in einem gemeinsamen Konzept, das Unternehmen unabhängiger von einzelnen Plattformen macht und gleichzeitig eine robuste Wiederherstellungsstrategie für kritische Daten bereitstellt.