cherdchai - stock.adobe.com

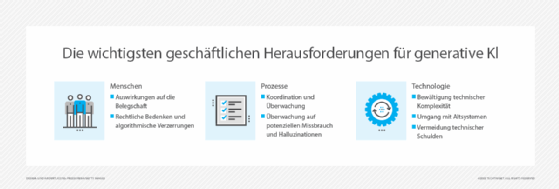

8 Herausforderungen bei der Umsetzung von generativer KI

IT-Manager, die die Einführung von generativer KI planen, müssen mit Herausforderungen rechnen, darunter Kostenoptimierung, Cybersicherheitsbedenken und Energieverbrauch.

Die Verbreitung generativer KI bietet sofortige Möglichkeiten, vielversprechende Zukunftsaussichten – und nicht wenige Fallstricke.

Diese Form der künstlichen Intelligenz (KI) hat 2022 mit der Veröffentlichung von ChatGPT und Dall-E 2 von OpenAI ihren Durchbruch geschafft. Diese Tools und ihre Nachfolger wie Claude von Anthropic, Google Gemini und Microsoft Copilot machen hochwertige, KI-generierte Inhalte zu einer alltäglichen Realität. Jedes dieser Produkte basiert auf einem Sprachmodell, einer Art maschinellem Lernmodell, das anhand riesiger Mengen von Trainingsdaten optimiert wurde.

Nutzer können KI-Modelle nun für eine Vielzahl von Aufgaben im Bereich der Inhaltserstellung nutzen: Text, Bild, Video, Audio und Softwarecode sind dabei gleichermaßen vertreten. Die potenziellen Vorteile dieser Technologie haben jedoch auch ihren Preis. Unternehmensleiter sollten die folgenden acht Herausforderungen im Zusammenhang mit generativer KI (GenAI) berücksichtigen.

1. Kostenkontrolle und ROI

Unternehmen, die GenAI einführten, begannen zunächst mit begrenzten Proof-of-Concept-Experimenten. In der Anfangsphase der Testanwendungen war der Preis noch kein vorrangiges Thema. Als IT-Manager jedoch begannen, Pilotprojekte auf breiter gefächerte Produktionssysteme auszuweiten, wurden die Kosten zu einem wichtigen Faktor. Die Herausforderung bestand nun nicht mehr in der Verwaltung der frühen Einführung, sondern in der Erzielung einer Kapitalrendite.

In der Anfangsphase der Entwicklung von generativer KI betrachteten Führungskräfte der Branche das Training von Large Language Models (LLMs) als einen der größten Kostenfaktoren. GenAI-Modelle können Milliarden oder sogar Billionen von Parametern enthalten, was sie für ein typisches Unternehmen zu einem komplexen Unterfangen macht. Die meisten Unternehmen verwenden jedoch Modelle von Anbietern wie Anthropic, Google, OpenAI oder Microsoft, anstatt eigene zu entwickeln. Dennoch zahlen Unternehmen für den Zugriff auf Modelle über APIs und müssen möglicherweise Kosten für deren Anpassung tragen.

Aber es gibt noch viele weitere Kosten, die über das Modell selbst hinausgehen. Eine Studie von McKinsey & Co. ergab, dass GenAI-Modelle nur etwa 15 Prozent der Kosten eines typischen Projekts ausmachen. Weitere Ausgaben entstehen für die Cloud-Migration, die Datenaufbereitung, das Change-Management und die Neugestaltung von Geschäftsprozessen. Während die Unternehmen auf die Kosten achten, sehen sie auch Umsatzchancen, um einen ROI zu erzielen.

2. Umgestaltung der Belegschaft

Generative KI verändert die Arbeitsweise in vielen Bereichen, was zu Befürchtungen hinsichtlich des Verlusts von Arbeitsplätzen führt. Die Entlassungen im Technologiesektor in den letzten Jahren wurden auf eine Reihe von Faktoren zurückgeführt, darunter steigende Zinsen in den Jahren 2022 und 2023 und Überbesetzungen während der COVID-19-Pandemie. Die Rolle der Einführung von generativer KI bei den Stellenstreichungen ist etwas unklar, aber zumindest scheint sie sich auf die Stellenangebote ausgewirkt zu haben.

Branchenbeobachter schließen Entlassungen zwar nicht aus, glauben jedoch, dass generative KI eher zu einer Veränderung der Arbeitsplätze der Beschäftigten führen wird als zu deren Wegfall. Arun Chandrasekaran, Vice President, Analyst und Mitglied des KI-Strategieteams bei Gartner, glaubt, dass generative KI einige der Aufgaben von Arbeitnehmern übernehmen wird. Die Anzahl der Aufgaben, die durch die Technologie automatisiert werden, werde jedoch je nach Position variieren, fügt er hinzu und stellt folgende Fragen: „Wie können wir Menschen umschulen, deren Arbeit zu einem großen Teil durch KI automatisiert wird? Welche Fähigkeiten müssen sie erwerben? Welche Rollen müssen sie übernehmen?“

Pablo Alejo, Gründer der Unternehmens- und Technologieberatung Copilot, sagt, generative KI schaffe neue Arbeitsplätze. „Ich glaube nicht, dass es sich um eine Situation handelt, in der alles verloren ist“, vermutete er. „Ich glaube vielmehr, dass sich dadurch Chancen für etwas Neues eröffnen.“

Das hat sich für Alejo bewahrheitet, einen ehemaligen Manager von Accenture und West Monroe, der 2024 seine eigene Beratungsfirma gegründet hat. Er nutzt generative KI, um Anwendungen zu schreiben und Kundenanalysen für seine Kunden durchzuführen.

3. Umgang mit Sicherheits- und Datenschutzbedenken

KI-Modelle senken die Kosten für die Erstellung von Inhalten. Das hilft Unternehmen, aber auch Angreifern, die bestehende Inhalte leichter verändern können, um Deepfakes zu erstellen. Digital veränderte Medien können das Original sehr genau nachahmen und hyperpersonalisiert sein. „Das umfasst alles von Stimm- und Videoimitationen über gefälschte Kunstwerke bis hin zu gezielten Angriffen“, sagte Chandrasekaran.

Datenverlust ist ein weiteres Sicherheitsproblem. Mitarbeiter können verschiedene GenAI-Tools nutzen und versehentlich sensible Unternehmensinformationen über deren Prompts preisgeben. „Diese neu entdeckte Schwachstelle wird einige etablierte Cybersicherheits-Tools wie Data Loss Prevention aufwerten“, sagt Bill Bragg, CIO beim Anbieter von Predictive-AI- und GenAI-Plattformen SymphonyAI. „Data Loss Prevention ist eine alte Technologie, aber sie ist extrem wichtig.“

Weitere Auswirkungen von generative KI auf die Cybersicherheit sind raffiniertere Phishing-Angriffe. Bedrohungsakteure nutzen GenAI-Tools, um überzeugende Nachrichten zu erstellen, mit denen sie ahnungslose Benutzer ködern. Sie können die Technologie auch einsetzen, um bösartigen Code zu schreiben, Software zu analysieren, um Angriffe zu planen, und ihre Hacking-Fähigkeiten zu verbessern.

4. KI-Halluzinationen und algorithmische Verzerrungen

GenAI-Systeme können bei der Beantwortung von Benutzeranfragen falsche oder irreführende Informationen liefern. Tools gelten als halluzinierend, wenn sie Antworten erfinden und Unternehmen damit rechtlichen und geschäftlichen Risiken aussetzen. Im Allgemeinen schaden Halluzinationen der Glaubwürdigkeit von KI. „Das Misstrauen gegenüber KI ist eine Herausforderung, mit der Anbieter von KI-Anwendungen heute konfrontiert sind“, erklärt Chandrasekaran.

KI-Anbieter und -Nutzer kämpfen auch mit algorithmischer Voreingenommenheit, einer weiteren Quelle rechtlicher Risiken. Wenn GenAI-Modelle mit fehlerhaften, unvollständigen oder nicht repräsentativen Datensätzen trainiert werden, liefern sie Ergebnisse, die systematisch voreingenommen sind. Unkontrolliert verbreitet sich die Voreingenommenheit der KI in den Systemen und beeinflusst Entscheidungsträger, die sich auf die Ergebnisse verlassen, was zu Diskriminierung führen kann.

„Diese Modelle werden massiv mit Internetdaten vortrainiert“, sagt Chandrasekaran. „Sie spiegeln die Voreingenommenheit des Internets wider.“

5. Koordination und Aufsicht

Neuere Technologien zwingen Unternehmen oft dazu, Kompetenzzentren einzurichten, die sich auf die effektive Einführung konzentrieren, und das war auch bei generative KI der Fall. Kompetenzzentren und ähnliche Gruppen können laut Chandrasekaran eine gute Möglichkeit sein, KI in einem Unternehmen zu skalieren. Sie können aber auch die Einführung behindern.

„Wir haben viele große Unternehmen diesen Weg gehen sehen“, erklärt er. „Einige waren erfolgreich, andere nicht. Oft scheitern sie, weil diese Gruppen oder Kompetenzzentren anfangen, sich selbst als ‚mein Weg oder kein Weg‘ zu sehen.“

Gruppen, die für die Koordination von generativer KI verantwortlich sind, können unempfindlich für die Bedürfnisse von Entwicklern, Erstellern und anderen Stakeholdern innerhalb eines Unternehmens werden. Chandrasekaran rät Unternehmen, eher wie ein Förster als wie ein Wachmann zu agieren – das heißt, GenAI-Anwendern eine Karte zu geben, ihnen Wege vorzuschlagen und ihnen bei Problemen Unterstützung anzubieten. Er beschrieb den Förster-Ansatz wie folgt: „Sie machen etwas Neues. Wie kann ich Ihnen sinnvoll helfen?“

Der Ansatz des Wächters oder Torwächters kann jedoch Schatten-KI fördern, die außerhalb der Unternehmensgrenzen operiert. Alejo verweist auch auf die Tendenz einiger Kompetenzzentren, übermäßig restriktiv zu sein und Mitarbeitern zu misstrauen. Die Grundwerte eines Unternehmens würden die richtige Nutzung von generativer KI fördern. „Ein Unternehmen, das Wert auf Datenschutz legt, wird auch KI entwickeln, die Wert auf Datenschutz legt“, sagt Alejo.

6. Umgang mit Altsystemen und technischen Altlasten

Die Integration von generativer KI in ältere Technologieumgebungen kann für Unternehmen zusätzliche Probleme mit sich bringen. Die Machbarkeit der Integration von Altsystemen kann sich insbesondere bei veralteten Client-Server- und Mainframe-Systemen als schwierig erweisen. Aber auch die aktuellen Unternehmensanwendungen stellen eine Herausforderung dar, und Unternehmen haben mit Datenqualität und -klassifizierung zu kämpfen. „Es gibt keine einfache Möglichkeit, Daten und Anwendungen in einen KI-Workflow zu integrieren“, sagt Chandrasekaran. „Sie haben technische Schulden in ihrer Datenlandschaft.“

Ironischerweise reiht sich generative KI schnell neben Legacy-Systemen und problematischen Daten in die Kategorie der technischen Schulden ein. „Da die Einführung generativer KI weiter zunimmt, müssen Unternehmen ihre technischen Schulden aktiv verwalten, um zu verhindern, dass sie ausufern“, heißt es in einem im Oktober 2024 veröffentlichten Bericht von Accenture. Das IT-Beratungsunternehmen befragte 1.500 Unternehmen, und 41 Prozent der Befragten nannten KI als Hauptursache für ihre technischen Schulden.

Die Ausbreitung von GenAI stellt laut Bragg Technologie-Manager vor eine schwierige Frage: „Können Sie gleichzeitig innovativ sein und Schulden abbauen?“

7. Energiebedarf

GenAI-Workloads tragen zu einem steigenden Stromverbrauch in Rechenzentren bei, wodurch die Verfügbarkeit und die Kosten von Energie zu einem Problem für die Unternehmens-IT werden.

Das Trainieren von LLMs und das Veranlassen von Antworten auf Benutzeranfragen sind rechenintensive Aktivitäten, die viel Strom verbrauchen. Darüber hinaus benötigen KI-Rechenzentren, die Wärme erzeugen, hochentwickelte Kühlsysteme, die noch mehr Energie verbrauchen. Um den KI-bedingten Bedarf zu decken, werden Fortune-500-Unternehmen laut dem Marktforschungsunternehmen Gartner bis 2027 500 Milliarden US-Dollar ihrer Energiebetriebsausgaben auf Microgrids umstellen. Microgrids bieten unabhängige Energiesysteme, um den Bedarf eines Unternehmens oder einer Unternehmensgruppe zu decken.

AWS, Google und Microsoft setzen unterdessen auf Kernenergie, um ihren Energiebedarf zu decken. Darüber hinaus untersucht das Stargate-Projekt, das 500 Milliarden US-Dollar in den Bau von KI-Rechenzentren investieren will, ebenfalls Energiequellen. Präsident Donald Trump stellte die Initiative im Januar 2025 vor, die von der Investmentfirma MGX, OpenAI, Oracle und SoftBank finanziell unterstützt wird. Bei der Vorstellung sagte Trump, seine Regierung werde die Stromerzeugung der Stargate-Rechenzentren erleichtern – laut veröffentlichten Berichten möglicherweise „in ihren eigenen Anlagen“. OpenAI strebt laut der Website des Unternehmens eine Partnerschaft mit „Unternehmen aus den Bereichen erneuerbare Energien und Nachhaltigkeit“ an.

Angesichts der vielfältigen Energiestrategien planen einige CIOs, die Energieeffizienzansätze eines KI-Anbieters als Kriterium für die Auswahl eines Lieferanten zu bewerten. Tatsächlich zählt der Energiebedarf zu ihren größten Herausforderungen für 2025.

8. Unsicherheit: Wie intelligent wird KI werden?

Unternehmen, die die Einführung von generativer KI planen, müssen angesichts der sich noch weiterentwickelnden Technologie auf Unsicherheiten vorbereitet sein. Wird generative KI weiterhin rasante Fortschritte machen oder wird es plötzlich zu einem KI-Winter kommen?

Die Herausforderung für Anwender besteht darin, dass sie nicht genau wissen, wo sie auf der Roadmap stehen. „Stehen wir noch am Anfang oder haben wir bereits die Obergrenze erreicht?“, fragt Alejo. Er glaubt, dass generative KI noch am Anfang steht, aber Unternehmen müssen die Möglichkeit berücksichtigen, dass sie an eine Grenze stoßen könnten, und was dies für ihre Innovationsfähigkeit bedeutet.

Chandrasekaran weist auch auf die Unsicherheit im Bereich KI und auf die anhaltende Debatte hin, ob künstliche allgemeine Intelligenz bald Realität wird oder noch Jahre entfernt ist. Er spielt auf die philosophische Debatte darüber an, ob künstliche allgemeine Intelligenz überhaupt das richtige Ziel ist. Ist es vielleicht besser, KI in Bereichen weiterzuentwickeln, in denen sie bereits hervorragende Leistungen erbringt?

Anwender von Technologien werden letztendlich erfahren, ob KI-Systeme in Zukunft mehr Intelligenz und Denkvermögen entwickeln werden. Bis dahin kann jeder nur spekulieren.