ภาà¸à¸ ูมิ à¸à¸±à¸

Datenqualitätsmanagement: Diese Funktionen braucht Ihr Tool

Firmen stehen müssen verlässliche Daten für Analysen und Prozesse bereitstellen. DQM-Tools kombinieren Automatisierung, Governance und KI, um Datenqualität zu sichern.

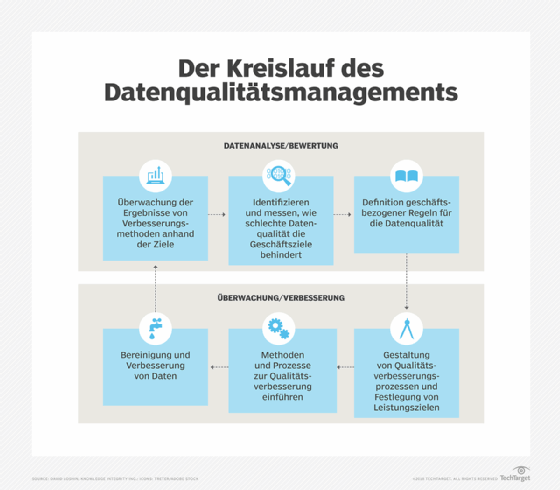

Die Sicherstellung der Datenqualität gehört weiterhin zu den zentralen Herausforderungen in Unternehmen, die zunehmend datengetriebene Entscheidungen treffen. Heutige Data Quality Management (DQM)-Tools sind heute weit mehr als reine Überwachungswerkzeuge; sie sind Plattformen, die umfassende Automatisierung, kollaborative Steuerung und KI-gestützte Analysen vereinen. Wer ein DQM-Tool auswählt, sollte daher auf folgende Funktionen achten:

- Datenprofilierung und Monitoring: Die kontinuierliche Analyse der Datenquellen zur Erkennung von Inkonsistenzen, Anomalien und Qualitätsmängeln ist fundamental. Fortschrittliche Tools bieten Echtzeit-Monitoring mit automatisierten Alarmen.

- Datenherkunft (Data Lineage): Transparente Rückverfolgbarkeit von Datenflüssen ermöglicht es, Fehlerquellen schnell zu identifizieren und die Einhaltung regulatorischer Vorgaben nachzuweisen.

- Metadaten-Management: Umfangreiche Verwaltung von Metadaten schafft die Grundlage für Governance, Taxonomien und intelligente Datenkataloge.

- Datenbereinigung und -standardisierung: Automatisierte Parsing-, Bereinigungs- und Normierungsprozesse erhöhen die Datenkonsistenz und -verwendbarkeit.

- Identitätsauflösung: Die Zusammenführung von Datensätzen, die sich auf dieselben Entitäten beziehen, verbessert die Datenintegrität, insbesondere in Kundenstammdaten (Master Data).

- Kollaborationsfunktionen: Workflow- und Ticketing-Systeme für Data Stewards und Fachabteilungen fördern die Zusammenarbeit und Qualitätssicherung.

- Self-Service-Analytics: Business-User können eigenständig auf bereinigte und qualitätsgeprüfte Daten zugreifen, ohne auf IT-Ressourcen angewiesen zu sein.

- Integration in verschiedenste Datenquellen: Moderne Tools unterstützen eine breite Palette an Datenbanken, Cloud-Plattformen, Data Lakes und Streaming-Systemen.

- KI-gestützte Automatisierung: Künstliche Intelligenz hilft bei der Anomalieerkennung, Priorisierung von Problemen sowie Vorschlägen zur Datenkorrektur.

- Echtzeit-Qualitätskontrollen: Insbesondere in hybriden Echtzeitarchitekturen spielt die automatische Prüfung bei Datenströmen eine wachsende Rolle.

- Data Governance und Compliance: Werkzeuge implementieren automatisierte Richtlinien und Auditprozesse, um Datenschutz-, Sicherheits- und Compliance-Anforderungen zu erfüllen.

Diese Funktionen bilden die Grundlage für belastbare, vertrauenswürdige Daten, die Datenplattformen und Analytik nutzen.

Zusätzliche Hinweise und Praxis-Tipps

Neben den funktionalen Kriterien eines DQM-Tools sollten Unternehmen weitere Aspekte berücksichtigen, die häufig über den Erfolg eines Datenqualitätsprogramms entscheiden:

- Organisatorische Verankerung: Datenqualität ist nicht ausschließlich ein technisches Thema. Klare Rollen wie Data Owner, Data Steward und definierte Verantwortlichkeiten sind entscheidend, um nachvollziehbare und nachhaltige Qualitätsprozesse zu etablieren.

- Change-Management und Schulungen: Auch die besten Tools entfalten ihren Nutzen nur, wenn Fachabteilungen geschult werden und die Bedeutung von Datenqualität im Tagesgeschäft verankert wird.

- Qualität über mehrere Daten-Domänen hinweg: Viele Tools unterstützen bestimmte Datenarten besonders gut (zum Beispiel Kundenstammdaten). Unternehmen sollten prüfen, ob die Software auch komplexe oder unstrukturierte Daten angemessen abdeckt.

- DSGVO und regulatorische Anforderungen: Gerade in Deutschland sind Datenschutz, Datenminimierung, Zweckbindung und Auditierbarkeit wichtige Kriterien. Ein DQM-Tool sollte die Umsetzung solcher Vorgaben unterstützen und Compliance-Prozesse nicht behindern.

- Technische Integration und Skalierbarkeit: Die beste Funktion nützt wenig, wenn das Tool schwer in bestehende Systeme integrierbar ist. Architektur, APIs, Cloud-Unterstützung und Automatisierungsmöglichkeiten sollten zum technischen Reifegrad des Unternehmens passen.

- Kosten, Lizenzmodelle und Wartung: DQM-Projekte verursachen laufende Kosten für Lizenzen, Cloud-Ressourcen und Betrieb. Eine frühe Kosten-/Nutzenabschätzung hilft, spätere Budgetprobleme zu vermeiden.

Anbieter und Lösungen

Der Markt für DQM-Software ist heute breit gefächert, dominiert von etablierten Spezialanbietern und zunehmend auch Cloud-Providern mit integrierten Lösungen. Führend sind Unternehmen wie Collibra, Informatica, Talend, Ataccama und IBM InfoSphere, die Plattformen anbieten, welche Datenqualitätsmanagement mit Data Governance und Metadatenverwaltung verzahnen. Diese Lösungen zeichnen sich durch tiefe KI-Integration, Workflow-Automatisierung und Self-Service-Features aus.

Parallel bieten Cloud-Anbieter wie AWS (Amazon Clean Rooms, AWS Glue Data Quality), Microsoft Azure Purview und Google Cloud Data Quality Services native Werkzeuge für die Datenqualitätskontrolle, die speziell für Cloud- und hybride Umgebungen optimiert sind. Sie integrieren nahtlos mit modernen Data Lakes und Data Warehouses und ermöglichen skalierbare Echtzeitprüfungen sowie umfassende Transparenz in Multi-Cloud-Architekturen.

Auch spezialisierte Lösungen von DataRobot, Ataccama oder Precisely erweitern den Markt mit KI-getriebenen Funktionen oder Fokus auf Branchen-compliance. Unternehmen müssen bei der Auswahl daher die Integration in ihre bestehende Infrastruktur, Automatisierungsgrad sowie die Governance-Anforderungen genau prüfen, um Effizienz und Qualität zu maximieren.