Sensvector-stock.adobe.com

Big-Data-Analytik und Business Intelligence: Ein Vergleich

BI und Big-Data-Analysen unterstützen verschiedene Arten von Analyseanwendungen. Durch ihre komplementäre Nutzung lässt sich eine umfassende Datenanalysestrategie realisieren.

Erfolgreiche Unternehmen entscheiden sich nicht zwischen Business Intelligence (BI) und Big-Data-Analytik. Stattdessen nutzen sie beide, um eine umfassende Datenanalysestrategie zu entwickeln, die sowohl aktuelle Geschäftsentscheidungen als auch zukünftige Innovationen unterstützt. Unternehmen, die BI und Big-Data-Analytik effektiv integrieren, sind gut positioniert, um ihre Geschäftsabläufe flexibel weiterzuentwickeln und anzupassen – und sich so einen Wettbewerbsvorteil gegenüber Konkurrenten zu verschaffen, die dies nicht tun.

Die beiden Technologieansätze sind für unterschiedliche Analyseszenarien konzipiert: Während BI einen Rahmen für die Analyse von Daten zur Optimierung von Abläufen bietet, erlaubt Big-Data-Analytik eine tiefere Datenexploration, die es einem Unternehmen besser ermöglicht, innovativ zu sein und sich an Veränderungen anzupassen. Aber sie ergänzen sich. Zusammen liefern sie wertvolle geschäftliche Erkenntnisse, die die immer komplexer werdenden Entscheidungen unterstützen, die datengesteuerte Unternehmen treffen müssen.

Daher müssen Führungskräfte im Bereich Datenmanagement und -analyse sowie ihre Teams darauf vorbereitet sein, beide Ansätze zu implementieren. Um sicherzustellen, dass ihr Potenzial voll ausgeschöpft wird, muss zunächst ein umfassendes Verständnis der Unterschiede zwischen BI und Big-Data-Analysen sowie der Integration dieser Ansätze in Analyseinitiativen vorhanden sein.

Business Intelligence versus Big-Data-Analysen

Das Aufkommen von BI-Software in den 1990er Jahren markierte einen Wandel von statischen Berichten hin zu einem systematischen Datenanalyseprozess, der aggregierte Daten und KPIs für Entscheidungsträger in Unternehmen bereitstellte. BI-Systeme basieren in der Regel auf Data Warehouses, in denen große Mengen historischer Geschäftsdaten gespeichert sind, die für analytische Abfragen optimiert sind. Diese Plattformen bieten im Wesentlichen ein strukturiertes Modell des zu analysierenden Geschäfts.

Um diese Art der Analyse besser zu unterstützen, wurden benutzerfreundlichere BI-Dashboards und interaktive Analyseanwendungen entwickelt. Ihre Verfügbarkeit führte zur Entwicklung von Self-Service-BI-Umgebungen, in denen Geschäftsanwender selbstständig Abfragen durchführen und Daten analysieren können, anstatt sich auf erfahrene BI-Experten verlassen zu müssen.

Heute umfasst BI eine breite Palette von Technologien und Verfahren zum Sammeln, Speichern, Analysieren und Visualisieren strukturierter Daten aus verschiedenen Quellsystemen. Beispielsweise sind KI-gesteuerte Schnittstellen für natürliche Sprache, die es Benutzern ermöglichen, Fragen in ihrer Sprache zu stellen, mittlerweile weit verbreitet. Integrierte KI-Funktionen schlagen auch Folgefragen vor, generieren Datenvisualisierungen und fassen BI-Ergebnisse zusammen. Das Ziel von BI bleibt jedoch dasselbe: umsetzbare Erkenntnisse zu liefern und die Entscheidungsfindung in allen Ebenen eines Unternehmens zu unterstützen.

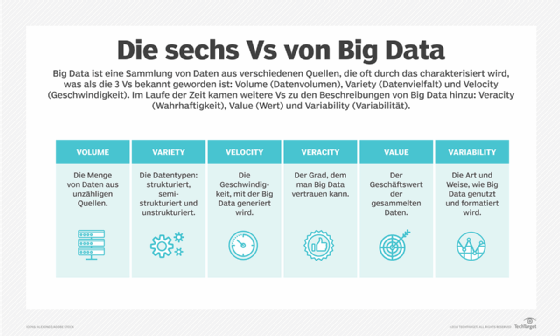

Das spätere Aufkommen der Big-Data-Analyse erweiterte die Möglichkeiten zur Generierung nützlicher Datenerkenntnisse noch weiter. Beschreibungen von Big Data konzentrieren sich oft auf deren Umfang und Komplexität, aber es geht um mehr als das. Wie Doug Laney, damals Analyst bei Meta Group Inc., 2001 erstmals feststellte, zeichnet sich Big Data in der Regel durch die folgenden drei Schlüsselelemente aus, die als die 3 Vs bekannt sind:

- Volume (Volumen): Big Data umfasst in der Regel Datensätze, die weitaus größer sind, als herkömmliche Datenverarbeitungswerkzeuge verarbeiten können.

- Velocity (Geschwindigkeit): Daten werden oft in Echtzeit oder nahezu in Echtzeit generiert und aktualisiert.

- Variety (Vielfalt): Big Data umfasst verschiedene Datentypen, darunter gemischte Pools aus strukturierten, unstrukturierten und semistrukturierten Daten.

Seitdem wurden verschiedene Listen erstellt, die diese Merkmale um weitere Eigenschaften ergänzen – am häufigsten um Veracity (Wahrhaftigkeit), Value (Wert) und Variability (Variabität), sodass insgesamt 6 Vs entstehen. Die ursprünglichen drei bleiben jedoch die relevantesten.

Aufgrund der verschiedenen Eigenschaften von Big Data entstehen komplexere Anforderungen an die Datenverarbeitung – und es bieten sich umfangreichere Analysemöglichkeiten als bei BI-Daten. Big-Data-Analysen gewinnen Erkenntnisse, die mit herkömmlichen BI-Methoden entweder nicht in großem Umfang oder gar nicht gewonnen werden können, darunter versteckte Muster in Datensätzen, Korrelationen zwischen Datenelementen und Datentrends im Zeitverlauf. Sie werden meist von erfahrenen Datenwissenschaftlern unter Verwendung fortschrittlicher Tools und statistischer Verfahren durchgeführt.

Wesentliche Unterschiede zwischen BI und Big-Data-Analysen

BI und Big-Data-Analysen unterscheiden sich erheblich in Bezug auf Datenarchitektur, Datenverarbeitungsmethoden und ihren analytischen Schwerpunkt, wie im Folgenden erläutert wird.

Datenarchitektur und Datenverarbeitung

BI-Anwendungen arbeiten in erster Linie mit strukturierten Datensätzen, die aus internen Quellen – wie Transaktionssystemen, SQL-Datenbanken und Tabellenkalkulationen – abgerufen, dann in Tabellen organisiert und in einem Data Warehouse für Abfragen und Analysen gespeichert werden. Abfragesprachen werden verwendet, um Zusammenfassungen, Berichte und Datenvisualisierungen zu erstellen. SQL ist die bekannteste Sprache; weitere sind die Sprache Data Analysis Expressions (DAX) von Microsoft und Multidimensional Expressions, eine ältere Sprache, die allgemein als MDX bekannt ist und ebenfalls von Microsoft entwickelt wurde.

Im Gegensatz dazu verarbeitet Big-Data-Analytik oft riesige Datenmengen in unterschiedlichen Formaten aus verschiedenen Datenquellen – nicht nur aus internen IT-Systemen, sondern auch aus Sensoren, E-Mails, Bildern, externen Datenbanken, sozialen Medien und mehr. Einige dieser Datensätze erfordern fortschrittliche Verarbeitungstechniken, um Erkenntnisse zu gewinnen. Andere erfordern eine Verarbeitung in einem solchen Umfang, dass die Datenanalyseaufgaben auf mehrere Server verteilt und die Ergebnisse konsolidiert werden müssen. Die verarbeiteten Rohdaten werden in der Regel in einem Data Lake gespeichert, wo sie unverändert analysiert oder gefiltert und für die Verwendung in verschiedenen Analyseanwendungen vorbereitet werden können.

Dieses Verarbeitungsniveau wird durch eine Kombination aus Big-Data-Technologien, Algorithmen für maschinelles Lernen und Skriptsprachen wie Python und R erreicht. Auch KI leistet mittlerweile einen Beitrag – und verwischt dabei die Grenze zwischen der Verarbeitung strukturierter und unstrukturierter Daten. Große Sprachmodelle (Large Language Model, LLM) lesen Dokumente, analysieren E-Mails, interpretieren Bilder und fassen Gespräche zusammen, ohne dass dafür aufwendige Pipelines zur Datenextraktion erforderlich sind. Dennoch ist die Verarbeitung von Big Data immer noch komplizierter als die Standardverfahren zum Extrahieren, Transformieren und Laden, die zum Einlesen von BI-Daten in ein Data Warehouse verwendet werden.

Die Häufigkeit der Datenaktualisierungen ist ein weiterer Unterschied zwischen BI und Big-Data-Analysen. BI-Daten, die die historische Leistung zusammenfassen, werden in der Regel regelmäßig aktualisiert, beispielsweise täglich, wöchentlich oder monatlich. Big-Data-Analysesysteme verarbeiten und aktualisieren Daten häufiger, auch in Echtzeit.

Analytischer Schwerpunkt

BI konzentriert sich in erster Linie auf deskriptive und diagnostische Analysen, die untersuchen, was in der Vergangenheit geschehen ist und warum, um aktuelle Geschäftsentscheidungen zu beeinflussen. Außerdem hilft es Unternehmen dabei, KPIs zu überwachen und operative Verbesserungen zu identifizieren. Daher nutzen Führungskräfte und Geschäftsleiter BI regelmäßig für strategische und taktische Entscheidungen.

Big-Data-Analysen umfassen ebenfalls solche Analysen, in der Regel jedoch in größerem Umfang. Sie werden meist für vorausschauende Zwecke eingesetzt und konzentrieren sich in erster Linie auf prädiktive Analysen, die zukünftige Geschäftsszenarien und Trends prognostizieren. Preskriptive Analysen, die Anleitungen zum Erreichen eines gewünschten Geschäftsergebnisses liefern, werden ebenfalls mit Big Data durchgeführt. Zu den gängigen Anwendungen von Big-Data-Analysen gehören die Vorhersage von Markttrends, die Verbesserung des Kundenerlebnisses und die Förderung von Produktinnovationen.

KI verwischt auch die Unterscheidung zwischen den analytischen Schwerpunkten, indem sie Geschäftsanwendern die Durchführung einiger prädiktiver Analyseaufgaben ermöglicht, für die zuvor Datenwissenschaftskenntnisse erforderlich waren. Dieser Bereich der KI-gestützten Analytik befindet sich jedoch noch in der Entwicklung. Derzeit erfordert die zuverlässige Interpretation von Big-Data-Analyseergebnissen noch ein fundiertes Verständnis der Prinzipien der Datenwissenschaft.

Wie profitieren Unternehmen von BI und Big-Data-Analytik?

Da BI und Big-Data-Analytik unterschiedlichen Zwecken dienen und unterschiedliche technische Methoden verwenden, bieten sie unterschiedliche geschäftliche Vorteile, die im Folgenden separat beschrieben werden.

BI: Strukturierter Ansatz für die Datenanalyse

Stellen Sie sich BI als einen modellgesteuerten Ansatz für die Datenanalyse vor, der häufig auf Geschäftsprozesse abgestimmt ist. BI-Anwendungen basieren auf vordefinierten Geschäftsmodellen, die ein gemeinsames Verständnis der Funktionsweise eines Unternehmens widerspiegeln und so strukturiert sind, dass sie bestehende Geschäftsabläufe widerspiegeln. Die daraus resultierenden Erkenntnisse beziehen sich auf standardisierte KPIs und andere Kennzahlen, die unternehmensweit überwacht werden können.

Dieser strukturierte Analyseansatz lässt sich direkt auf strategische Ziele übertragen, was Folgendes ermöglicht:

- Konsistente Verfolgung wichtiger Geschäftsinitiativen.

- Vereinfachte Verwaltung von Corporate-Governance- und Compliance-Prozessen.

- Einfachere Identifizierung von Engpässen und Ineffizienzen in Geschäftsprozessen.

- Messung der operativen Leistung anhand festgelegter Benchmarks.

- Entscheidungsunterstützung für kontinuierliche Verbesserungs- oder Qualitätsmanagementmaßnahmen.

Big-Data-Analytik: Explorativer Datenanalyseansatz

Im Gegensatz zum strukturierten Charakter von BI verfolgt die Big-Data-Analytik einen eher explorativen Ansatz. Big-Data-Analytik-Anwendungen basieren in der Regel nicht auf bestehenden Geschäftsmodellen, sondern auf den Daten, die generiert und gesammelt werden. So können sie beispielsweise Muster in Rohdaten entdecken, die unvorhergesehene Veränderungen auf dem Markt, im Kundenverhalten oder in den Abläufen eines Unternehmens widerspiegeln.

Datenwissenschaftler verwenden Techniken wie Hypothesentests und prädiktive Modellierung, um diese Datenmuster oder andere Datenentdeckungen zu identifizieren, zu testen und zu analysieren. Die gewonnenen Erkenntnisse unterstützen dabei, Geschäftsrisiken und -chancen sowie den Bedarf an neuen Prozessen zu identifizieren, sodass Unternehmen schneller auf sich ändernde Geschäftsbedingungen reagieren können.

Die folgende Tabelle fasst die einzelnen allgemeinen Vorteile von BI und Big-Data-Analysen für Unternehmen zusammen.

| Vorteile von Business Intelligence | Vorteile von Big-Data-Analysen |

| Beantwortet bekannte Fragen | Wirft neue Fragen auf |

| Überwacht etablierte Kennzahlen | Entdeckt unbekannte Kennzahlen |

| Unterstützt die taktische Umsetzung | Ermöglicht strategische Innovationen |

| Sorgt für strategische Ausrichtung | Identifiziert neue Chancen |

| Behält die operative Kontrolle | Treibt transformative Veränderungen voran |

Wie BI und Big Data integriert werden können

Die effektivsten Unternehmen setzen beide Analyseansätze ein. Sie nutzen BI, um Geschäftsstrategien umzusetzen und operative Taktiken zu optimieren, und Big-Data-Analysen, um die strategische Entwicklung voranzutreiben, sich an neue Entwicklungen anzupassen und Geschäftsinnovationen zu operationalisieren.

Die beiden Prozesse können auch integriert werden. Big-Data-Technologien können Strukturen aus unstrukturierten Datenquellen extrahieren, sodass BI-Tools mit den Daten arbeiten können. Darüber hinaus können die Ergebnisse der Big-Data-Analyse als Tabellen für die Verwendung in BI-Tools bereitgestellt werden. Beispielsweise kann eine Tabelle mit prognostizierten Customwerten in ein Kundenservice-Dashboard eingebettet werden.

Ebenso können Datenwissenschaftler BI-Daten in Big-Data-Analyse-Workflows integrieren, wenn ihre Analysearbeit gut strukturierte Daten erfordert. In Branchen wie Finanzdienstleistungen und Gesundheitswesen kann ein Data Warehouse sorgfältig strukturierte Kunden- oder Patientendaten enthalten, um die Einhaltung gesetzlicher Vorschriften zu gewährleisten. Ein Datenwissenschaftler könnte diesen bereinigten und konformen Datensatz verwenden, um sicherzustellen, dass die von einer Analyseanwendung generierten Erkenntnisse unter den geltenden rechtlichen Rahmenbedingungen umsetzbar sind.

Ein Data Lakehouse ist eine neuere Plattform, die diese Art von Integrationen unterstützt. Wie der Name schon sagt, kombiniert es die wichtigsten Funktionen von Data Lakes und Data Warehouses und bietet eine einzige Plattform für BI- und Big-Data-Analytics-Anwendungen – und zunehmend auch für KI-Anwendungen.

Beispiele für BI- und Big-Data-Analytics-Anwendungen

Die folgende Tabelle enthält Beispiele für Anwendungen für BI und Big-Data-Analytics, um zu zeigen, wie sie sich voneinander unterscheiden und ergänzen.

| Business-Intelligence-Anwendungen | Big-Data-Analyseanwendungen |

| Monatliche Dashboards zur Sales Performance | Simulation des Absatzes neuer Produkte |

| Lagerumschlagshäufigkeit nach Standort | Prognose von Markttrends |

| Kennzahlen zur pünktlichen Lieferung | Analyse der Risiken von Unterbrechungen in der Lieferkette |

| Lösungszeiten für Kunden-Support-Tickets | Modelle zur Vorhersage der Kundenabwanderung |

| Rentabilitätsanalyse nach Abteilung oder Geschäftsbereich | Modellierung des Kreditrisikos |

| Berichterstattung über Budget versus Ist-Leistung | Echtzeit-Analyse der Stimmung in sozialen Medien |

| Kennzahlen zur Qualitätssicherung | A/B-Testanalyse |

KI: Ein möglicher dritter Analyseansatz

KI bietet Analysefunktionen, die sich von denen von BI und Big-Data-Analysen unterscheiden. KI-Systeme können mit Daten jeder Größenordnung arbeiten, von einer einzelnen Tabelle bis hin zu riesigen Datensätzen, die über mehrere Systeme verteilt sind. Während BI Fragen durch strukturierte Abfragen beantwortet und Big-Data-Analysen Erkenntnisse durch statistische Verfahren gewinnen, analysiert KI Daten durch eine Form des analytischen Dialogs.

Ein Business-Analyst, der einen Umsatzrückgang untersucht, kann beispielsweise einem KI-Tool eine Reihe von Fragen stellen: Wie hoch war der Umsatz im letzten Quartal nach Regionen, welche Verhaltensmuster lassen eine Kundenabwanderung erwarten, warum verlassen die besten Kunden das Unternehmen und wie kann dieses Problem gelöst werden? Das KI-Tool fasst Informationen aus mehreren Quellen zusammen, zieht Schlussfolgerungen, stellt Hypothesen auf und erklärt seine Überlegungen in Form eines Dialogs.

Der Analyst wiederholt dann den Vorgang mit dem Tool, verfeinert Fragen, hinterfragt Interpretationen und arbeitet auf ein tieferes Verständnis hin. KI kann auch Themen vorschlagen, die es wert sind, untersucht zu werden, oder Anomalien erklären, die statistische Methoden entdecken, aber nicht interpretieren können. Die Arbeit damit fühlt sich eher wie eine Zusammenarbeit an als die traditionelle Verwendung von Analysetools.