heyengel - stock.adobe.com

Neue In-Memory-Technologien aus dem Silicon Valley

Das Silicon Valley gilt als Mekka für Firmengründungen. Die dreiteilige Artikelserie widmet sich einigen dieser Unternehmen. Im ersten Teil geht es um In-Memory-Technologien.

Anmerkung der Redaktion: Diese dreiteile Artikelserie stellt zehn Unternehmen im Bereich Datenbank- und Datenmanagementsoftware sowie IT-Management vor. Im ersten Artikel werden drei Firmen präsentiert, die aus dem Bereich In-Memory Computing kommen: Hazelcast, Redis Labs und GridGain.

Der zweite Artikel dreht sich um Organisationen, die im Bereich Datenanalyse und Datenmanagement beheimatet sind: Alation, DataGrail, Fivetrans und Promethium. Schließlich stehen im dritten Artikel drei Anbieter aus unterschiedlichen IT- und Softwarebereichen im Zentrum: NGINX, Kaseya und Anaplan.

Das Silicon Valley gilt als Mekka für Unternehmensgründungen. Wer in der IT-Industrie erfolgreich sein möchte, muss in San Francisco und Umgebung präsent sein. In diesem und zwei weiteren Artikeln werfen wir einen Blick auf Unternehmen, die sich im Software-, Datenmanagement- und IT-Management-Segment etabliert haben oder Fuß fassen wollen. Als Teil einer Tour durch das Silicon Valley und San Francisco konnte TechTarget Einblicke in diese Organisationen gewinnen.

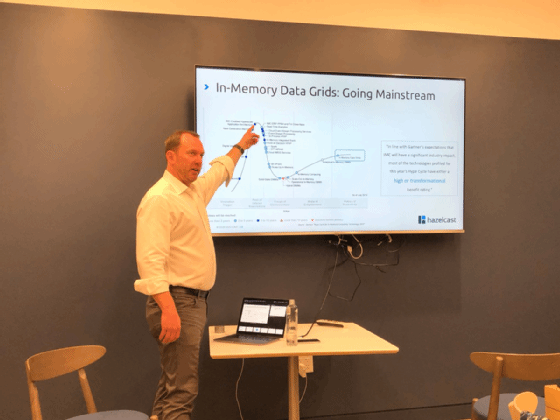

Hazelcast: In-Memory-Verarbeitung über Data Grids

Hazelcast hat sich seit seiner Gründung 2008 einen Namen im Bereich der verteilten Datenarchitektur gemacht. Ähnlich wie GridGain, Redis Labs oder Memcache hat man sich auf In-Memory-Datenverarbeitung spezialisiert.

Laut Kelly Herell, CEO von Hazelcast, reichen Legacy-Systeme, aber auch die meisten neueren Verarbeitungsplattformen nicht aus, um das volle Potenzial aus Unternehmensdaten auszuschöpfen. „Um neue Anwendungsszenarien in Cloud-Umgebungen oder das Internet der Dinge zu bewältigen, müssen Anwendungen sensibel reagieren können und dürfen keine langen Reaktionszeiten haben. Unternehmen benötigen Lösungen, bei denen die Verarbeitung in Echtzeit stattfindet“, sagt Herell. „Nur In-Memory Grids können diese Herausforderung in Millisekunden lösen.“

Wie bei allen In-Memory-Anwendungen lädt der Benutzer einen Teil der Daten, die er verarbeiten und analysieren möchte, in den Arbeitsspeicher und erhält je nach Größe des importierten Datensatzes innerhalb von Sekundenbruchteilen die gewünschten Antworten.

Um die Bedeutung dieses Konzepts zu unterstreichen, weist der CEO von Hazelcast darauf hin, dass mehr als 50 führende Finanzinstitute die Lösung verwenden, ebenso wie große Webhändler und Kommunikationsdienstleister. Dabei werden mittlerweile 40 Prozent des Umsatzes von Hazelcast in Europa erwirtschaftet.

Seit Ende Februar 2019 bietet der Anbieter auch die Möglichkeit, seine Lösung in der Cloud einzusetzen. Hazelcast Cloud bietet Anwendern einen kostenlosen Einstieg mit 200 MB Speicher. Als Cloud-Umgebung wird Amazon Web Services (AWS) unterstützt, Microsoft Azure und Google Cloud Platform stehen für die kommenden Monate auf der Roadmap.

Neben einer kostenlosen Version stellt man außerdem Hazelcast Cloud-Enterprise Version und Hazelcast Cloud Dedicated zur Verfügung. Die Enterprise-Version erlaubt bis zu 400 GB Arbeitsspeicher und unterstützt TLS/SSL. Im Angebot ist Standard-Support enthalten.

Die dedizierte Cloud-Lösung ist Private-Cloud-Umgebungen mit hohen Lasten für High Performance Computing oder Analytics vorbehalten. Eine Einschränkung der Speichergröße gibt es bei Hazelcast Cloud Dedicated nicht. Darüber hinaus bietet das Angebot Multithreading, Support und Geolokalisierungsfunktionen. Die Verfügbarkeit der dedizierten Version ist für die Jahresmitte 2019 geplant. Die beiden anderen Cloud-Lösungen sind ab sofort auf AWS sowohl als kostenpflichtige als auch kostenlose Version verfügbar.

Mitte April 2019 kündigte das Unternehmen auch die allgemeine Verfügbarkeit von Hazelcast Jet an, einer Event Streaming Engine ohne externe Systemabhängigkeiten. Das Tool lässt sich sowohl in eingeschränkten Umgebungen, wie IoT-Sensoren, aber auch in Cloud-Umgebungen verwenden. Es erfasst, kategorisiert und verarbeitet große Datenmengen mit geringer Latenzzeit, um eine kontinuierliche Bearbeitung zu unterstützen. Weiter Einzelheiten zum Angebot finden sich auf der entsprechende Website.

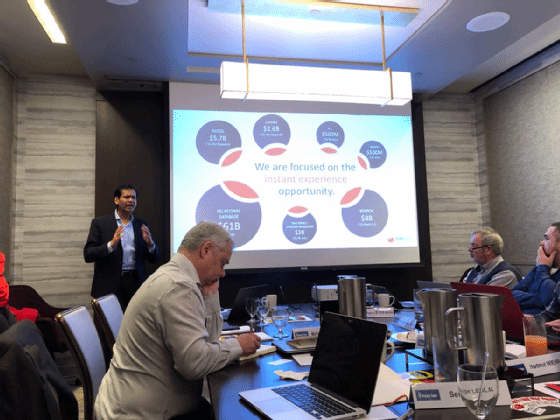

Redis Labs möchte mit Geschwindigkeit punkten

Redis Labs hat sich seit seiner Gründung 2009 zum Ziel gesetzt, moderne und effiziente Datenbanken für Cloud-Anwendungen zu entwickeln. Mit Reaktionszeiten von weniger als 100 Millisekunden möchte der Anbieter punkten.

Im Zentrum dieser Bemühung steht Redis, eine Open Source In-Memory-Datenarchitektur, die als Datenbank, Cache und Message Broker verwendet werden kann. Redis unterstützt zum Beispiel Datenstrukturen wie Strings, Hashes, Datensätze, Bitmaps, Hyperloglogs, Geodaten mit Radiusabfragen und Streams. Die In-Memory-Datenbank verfügt über integrierte Replikation, Lua-Skripting, LRU-Mangement für Cache-Speicher, Transaktionsverarbeitung sowie Hochverfügbarkeit über Redis Sentinel und automatische Partitionierung mit Redis Cluster.

„Die Redis-Software läuft aktuell auf rund einer Million Datenbanken, die sowohl auf der Open-Source-Version als auch auf der von Redis Labs gepflegten Enterprise-Version arbeiten“, erläutert Manish Gupta, Chief Marketing Officer bei Redis Labs.

Daneben lassen sich seit Anfang April 2019 mit der neuen Anwendung RedisGears alle Daten unabhängig von ihrem Format transformieren und verarbeiten sowie bei Datenänderungen anpassen. Die Softwarelösung arbeitet ohne Administration, also ereignisgesteuert, und folgt dem Serverless-Ansatz. Darüber hinaus unterstützt Redis Labs mittlerweile Zeitreihenmodellen, um Trends in großen Datenmengen zu identifizieren.

RedisAI eliminiert die Trennung zwischen Datenaufnahme und Modellausführung durch speziell entwickelte KI-Algorithmen, um Analysevorgänge so nah wie möglich an den Daten anzustoßen. Nach Angaben von Gupta sind damit auch Echtzeit-Anpassungen von Daten möglich, die sich in Bewegung befinden.

Die Lösung lässt sich in die wichtigsten Frameworks für künstliche Intelligenz einschließlich TensorFlow integrieren. Die Edge-Computing-Lösung RedisEdge bringt wiederum Datenbankfunktionen an die Edge des Unternehmensnetzwerks, um Milliarden von Nachrichten von verschiedener Hardware und Sensoren für die Echtzeitanalyse zu unterstützen.

Eine Partnerschaft mit Intel bewirkt seit kurzem auch eine erweiterte Hardwareunterstützung, indem die Datenverarbeitung mit Redis Enterprise auch auf den Optane Persistent Memory Speichermodulen möglich ist.

Besondere Aufmerksamkeit verursachte in jüngster Zeit die Änderung des Lizenzmodells bei Redis Labs. Das Unternehmen hatte die Softwarelizenz geändert, um zu verhindern, dass Cloud-Anbieter Managed-Services auf Basis des frei verfügbaren Redis-Datenbankcodes generieren.

Redis CMO Gupta verweist darauf, dass Redis Core weiterhin unter dem Open-Source-Lizenzmodell BSD 3 lizenziert ist. Ein Team um Salvatore Sanfilippo, dem Schöpfer von Redis, verwaltet die Redis- Lösung unabhängig. Die Open-Source-Variante enthält alle Bestandteile, die für den Betrieb eines verteilten Datenbanksystems erforderlich sind, einschließlich Replikation, Auto-Failover, Datenpersistenz und Clustering.

Auch wenn die Redis-Datenbank und -Tools weiterhin unter die BSD-3-Lizenz fallen, werden bestimmte Komponenten, zum Beispiel RediSearch, RedisGraph, RedisJson, RedisBloom und RedisML, durch kommerzielle Vereinbarung abgedeckt. Diese Änderung erfolgt nur sechs Monate nach Einführung der Apache-2.0- und modifizierten Common-Clause-Lizenzierung.

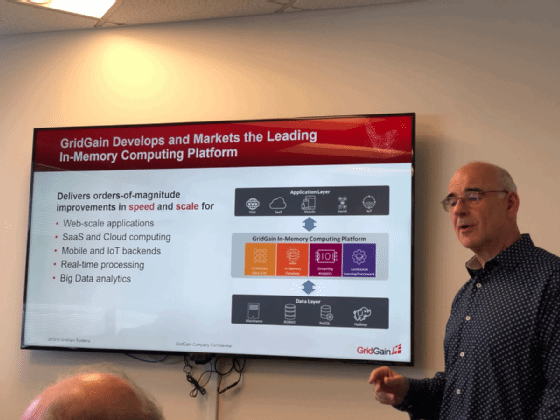

GridGain: Mit neuen Technologien auf Wachstumskurs

GridGain verfolgt seinen In-Memory-Computing-Ansatz seit 2007 und konnte seit der Veröffentlichung seiner Datagrids bereits über vier Millionen Downloads der Anwendung verzeichnen. „Es dauerte allerdings zehn bis zwölf Jahre, um eine solche Technologie zu bauen“, sagt Abe Kleinfeld, CEO von GridGain.

Dieser lange Atem hat sich gelohnt: Pro Quartal kommen zehn bis 15 zahlende Kunden hinzu. Mit einem durchschnittlichen Umsatzwachstum von über 100 Prozent und mehr als 30 Millionen Dollar Investitionskapital, das GridGain in den vergangenen Jahren einsammeln konnte, hat das Unternehmen eine gute Ausgangsbasis, um im Wettbewerb mit In-Memory-Wettbewerbern zu konkurrieren. „Ende 2020 wollen wir profitabel sein“, ergänzt Kleinfeld.

Für den EMEA-Markt ist er ebenfalls optimistisch: „Wir streben für 2019 eine Verdoppelung der Zahl der Neukunden gegenüber 2018 an, was sich in unseren signifikanten Zuwächsen in den Bereichen Vertrieb und Marketing in EMEA in diesem und im nächsten Jahr zeigt.“

Um dieses Wachstum voranzutreiben, hat GridGain in den letzten Monaten an den technologischen Stellschrauben gedreht: Die Professional Edition 2.4 bietet nun ein Continuous Learning Framework, welches Machine Learning und ein mehrschichtiges, neuronales Perceptron-Netzwerk umfasst. „Das Continuous Learning Framework erlaubt es Unternehmen, Machine- und Deep-Learning-Algorithmen in Echtzeit mit operativen Datensätzen zu vergleichen“, erläutert der GridGain Geschäftsführer.

Im letzten Quartal 2018 hat das Unternehmen außerdem die native Integration von TensorFlow angekündigt, wobei GridGain zum Data Store für Workflows mit TensorFlow wird. Die Lösung fügt Fehlertoleranzfunktionen bei der Verarbeitung sowie einen Neustart zum Zeitpunkt des Ausfalls hinzu. Befindet sich TensorFlow auf demselben Knoten wie GridGain, funktioniert das Verschieben der zu verarbeitenden Daten fast in Echtzeit. Für das Hadoop-Ökosystem hat GridGain außerdem Konnektoren für Spark und Kafka hinzugefügt.

Eine weitere wichtige Achse ist die Diversifizierung in Richtung Cloud Computing und die Einführung der GridGain Cloud. Das Angebot wird von GridGain verwaltet und vom Anbieter als In-Memory Cache as a Service. „GridGain Cloud ermöglicht es Benutzern, einen verteilten In-Memory-Cache bereitzustellen und über ANSI-99 SQL, Key-Value oder REST APIs darauf zuzugreifen“, erläutert Kleinfeld.

Im ersten Quartal 2019 hat das Unternehmen die GridGain Community Edition veröffentlicht. Die Community Edition fußt auf der Apache-Ignite-Codebasis, dem Open-Source-Projekt, auf dem der In-Memory Datagrid von GridGain aufbaut. Über die kostenlose Version sollen Patches und Upgrades für die Ignite Community bereitgestellt werden. Nach Angaben von Kleinfeld erreichen damit Updates und Weiterentwicklungen den Anwender schneller als über den üblichen Release-Zyklus.

Die Software lässt sich sowohl On-Premises als auch in Private- oder Public-Cloud-Umgebungen einsetzen. Der Einsatz als In-Memory-Datenbank ist mit der Community Edition ebenfalls möglich. Die Plattform lässt sich kostenlos auf der Website von GridGain herunterladen.