Native Cloud-Anwendung

Was ist eine native Cloud-Anwendung?

Eine native Cloud-Anwendung ist ein Programm, das für eine Cloud-Computing-Architektur entwickelt wurde. Diese Anwendungen werden in der Cloud ausgeführt und gehostet und sind so konzipiert, dass sie die inhärenten Eigenschaften eines Cloud-Computing-Softwarebereitstellungsmodells nutzen. Eine native App ist eine Software, die für die Verwendung auf einer bestimmten Plattform oder einem bestimmten Gerät entwickelt wurde. Cloud-native Apps sind darauf zugeschnitten, eine konsistente Entwicklungs- und automatisierte Verwaltungserfahrung über Private, Public und Hybrid Clouds hinweg zu bieten.

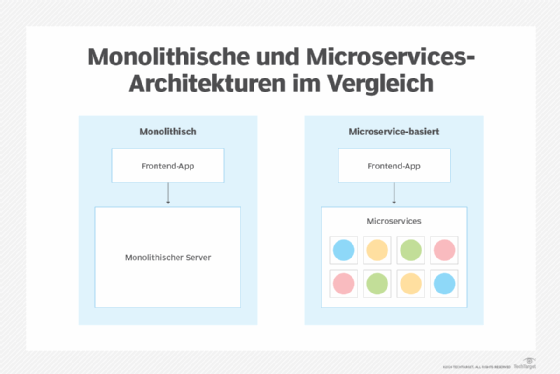

Native Cloud-Anwendungen verwenden eine Microservices-Architektur. Diese Architektur weist jedem von der Anwendung verwendeten Dienst effizient Ressourcen zu, wodurch die Anwendung flexibel und an eine Cloud-Architektur anpassbar wird.

Befürworter von DevOps-Praktiken nutzen native Cloud-Anwendungen aufgrund ihrer Fähigkeit, die geschäftliche Agilität zu fördern. Sie werden anders als herkömmliche monolithische Cloud-Anwendungen entworfen, entwickelt und bereitgestellt. Native Cloud-Anwendungen zeichnen sich durch kürzere Anwendungslebenszyklen aus und sind äußerst widerstandsfähig, verwaltbar und beobachtbar.

Was ist die Cloud Native Computing Foundation?

Die Cloud Native Computing Foundation (CNCF) ist eine herstellerneutrale Organisation, die 2015 gegründet wurde. Die CNCF fördert die Einführung und Entwicklung von Cloud-nativen Technologien und unterstützt Open-Source-Projekte, die bei der Entwicklung, Bereitstellung und Verwaltung skalierbarer Anwendungen in Cloud-Umgebungen unterstützen.

Die CNCF fördert die Zusammenarbeit zwischen Entwicklern, Anwendern und Anbietern und legt einen Schwerpunkt auf Microservices, Container und Orchestrierungstechnologien wie Kubernetes. Das Hauptziel der CNCF ist es, ein Ökosystem rund um native Cloud-Anwendungen und Praktiken zu schaffen, indem sie verschiedene Ressourcen, darunter Schulungs- und Zertifizierungsprogramme, bereitstellt.

Grundlagen der nativen Cloud-Anwendungsarchitektur

Native Cloud-Anwendungen nutzen die Vorteile von Cloud-Computing-Frameworks und deren lose gekoppelten Cloud-Services. Da nicht alle Dienste auf demselben Server laufen, müssen Entwickler von nativen Cloud-Anwendungen mithilfe softwarebasierter Architekturen ein Netzwerk zwischen den Rechnern aufbauen. Die Dienste befinden sich auf verschiedenen Servern und werden an unterschiedlichen Standorten ausgeführt. Diese Architektur ermöglicht eine horizontale Skalierung der Anwendungen.

Da die Infrastruktur, die eine native Cloud-Anwendung unterstützt, nicht lokal ausgeführt wird, müssen diese Anwendungen redundant ausgelegt sein. Dadurch kann die Anwendung einen Geräteausfall überstehen und IP-Adressen automatisch neu zuordnen.

Einige native Cloud-Architekturen verwenden auch Serverless Computing, bei dem Entwickler Anwendungen erstellen und ausführen können, ohne die zugrunde liegende Infrastruktur verwalten zu müssen. In einem serverlosen Modell werden Routineaufgaben von den Cloud-Anbietern übernommen, sodass sich die Entwickler darauf konzentrieren können, den Code schneller als bei herkömmlichen Anwendungen und Ansätzen in die Produktion zu bringen.

Merkmale einer nativen Cloud-Anwendung

Die Microservices, die Teil der nativen Cloud-App-Architektur sind, werden in Containern gepackt, die über Programmierschnittstellen (APIs) miteinander verbunden sind und kommunizieren. Orchestrierungs-Tools werden verwendet, um alle diese Komponenten zu verwalten.

Hier sind einige der wichtigsten Funktionen dieser Anwendungen:

- Microservices-basiert: Microservices zerlegen eine Anwendung in eine Reihe unabhängiger Dienste oder Module. Jeder Dienst referenziert seine eigenen Daten und unterstützt ein bestimmtes Geschäftsziel. Diese Module kommunizieren über APIs miteinander.

- Containerbasiert: Container sind eine Art von Software, die die Anwendung logisch isoliert, sodass sie unabhängig von physischen Ressourcen ausgeführt werden kann. Container verhindern, dass Microservices sich gegenseitig stören. Sie verhindern, dass Anwendungen alle gemeinsam genutzten Ressourcen des Hosts verbrauchen. Außerdem ermöglichen sie mehrere Instanzen desselben Dienstes.

- API-basiert: APIs verbinden Microservices und Container und sorgen gleichzeitig für vereinfachte Wartung und Sicherheit. Sie ermöglichen die Kommunikation zwischen Microservices und fungieren als Bindeglied zwischen den lose gekoppelten Diensten.

- dynamische Orchestrierung: Containerorchestrierungs-Tools werden zur Verwaltung von Containerlebenszyklen verwendet, die komplex werden können. Containerorchestrierungs-Tools übernehmen das Ressourcenmanagement, das Load Balancing, die Planung von Neustarts nach einem internen Ausfall sowie die Bereitstellung von Containern auf Servercluster-Knoten.

- Unterstützung für CI/CD-Pipelines: CI/CD-Verfahren automatisieren das Testen und die Bereitstellung von nativen Cloud-Anwendungen und optimieren den Packaging- und Bereitstellungsprozess in verschiedenen Umgebungen. Da native Cloud-Anwendungen CI/CD-Pipelines unterstützen, sind Test- und Bereitstellungsfunktionen automatisiert, was zu einer schnelleren Veröffentlichung neuer Funktionen und Updates sowie zu kürzeren Anwendungslebenszyklen führt.

- Unterstützung verschiedener Sprachen und Frameworks: Bei der Entwicklung nativer Cloud-Anwendungen können Entwickler flexibel aus einer Vielzahl von Programmiersprachen und Frameworks wählen. Beispielsweise können Entwickler die Benutzeroberfläche (UI) einer Anwendung mit Node.js erstellen und die APIs mit MicroProfile in Java entwickeln.

Vergleich von Cloud-basierten Anwendungen und nativen Cloud-Anwendungen

Die Begriffe Cloud-native und Cloud-basierte Anwendungen werden oft verwechselt. Beide laufen zwar auf Public-, Private- oder Hybrid-Cloud-Infrastrukturen, unterscheiden sich jedoch in ihrem Design wie folgt:

- Native Cloud-Anwendungen sind speziell für die Cloud konzipiert.

- Cloud-basierte Anwendungen sind für die Nutzung der Cloud und von Cloud-Plattformen konzipiert.

- Die Entwicklung nativer Cloud-Anwendungen ist für die inhärenten Eigenschaften der Cloud optimiert und an die dynamische Umgebung der Cloud anpassbar.

- Cloud-basierte Anwendungen können die dynamische Cloud-Infrastruktur nutzen, schöpfen jedoch nicht alle Vorteile der Cloud aus.

- Native Cloud-Technologien und -Anwendungen sind von Grund auf so konzipiert, dass sie die Vorteile der Cloud nutzen, beispielsweise Microservices und containerisierte Anwendungen.

- Cloud-basierte Anwendungen sind in der Regel bereits vorhandene Anwendungen, die ohne größere architektonische Änderungen in die Cloud migriert wurden.

- Dank ihrer Microservices-Architektur und der Containerisierung von Diensten können native Cloud-Anwendungen nahtlos und automatisch an den Bedarf angepasst werden.

- Cloud-basierte Workloads und Anwendungen erfordern oft einen höheren manuellen Aufwand, da sie stärker auf traditionelle monolithische Architekturen angewiesen sind.

- Native Cloud-Anwendungen sind in der Regel flexibler und portabler, sodass sie leicht zwischen verschiedenen Cloud-Anbietern oder -Umgebungen übertragen werden können.

- Cloud-basierte Anwendungen können aufgrund ihres ursprünglichen Designs und ihrer Abhängigkeiten von einer bestimmten Infrastruktur mit Portabilitätsproblemen konfrontiert sein.

- Native Cloud-Anwendungen sind in der Regel kostengünstiger, da Unternehmen nur für die Dienste bezahlen, die sie tatsächlich nutzen.

- Cloud-basierte Anwendungen können potenziell teurer sein, da sie die Cloud-Ressourcen nicht immer vollständig ausnutzen.

Vorteile von nativen Cloud-Anwendungen

Native Cloud-Anwendungen sind darauf ausgelegt, die Geschwindigkeit und Effizienz der Cloud zu nutzen. Zu den Vorteilen ihrer Verwendung zählen unter anderem:

- Kosteneffizienz: Mit nativen Cloud-Anwendungen können Rechen- und Storage-Ressourcen nach Bedarf skaliert werden. Dadurch entfällt die Überprovisionierung von Hardware und die Notwendigkeit von Load Balancing. Virtuelle Maschinen oder Server können für Tests einfach hinzugefügt werden, und native Cloud-Anwendungen sind schnell einsatzbereit. Container können auch verwendet werden, um die Anzahl der auf einem Host ausgeführten Microservices zu maximieren, was Zeit, Ressourcen und Geld spart.

- unabhängige Skalierbarkeit: Jeder Microservice ist logisch isoliert und kann je nach Bedarf unabhängig skaliert werden. Wenn ein Microservice geändert wird, um ihn zu skalieren, sind die anderen davon nicht betroffen. Sollten einige Komponenten einer Anwendung schneller aktualisiert werden müssen als andere, ist dies mit einer nativen Cloud-Architektur problemlos möglich.

- Portabilität: Native Cloud-Anwendungen sind herstellerneutral und verwenden Container, um Microservices zwischen den Infrastrukturen verschiedener Anbieter zu portieren, wodurch eine Herstellerabhängigkeit vermieden wird.

- Zuverlässigkeit: Wenn in einem Microservice ein Fehler auftritt, hat dies keine Auswirkungen auf benachbarte Dienste, da diese Cloud-Anwendungen Container verwenden.

- einfache Verwaltung: Native Cloud-Anwendungen nutzen Automatisierung, um App-Funktionen und Updates bereitzustellen. Entwickler können alle Microservices und Komponenten während der Aktualisierung verfolgen. Da Anwendungen in kleinere Dienste unterteilt sind, kann sich ein Engineering-Team auf einen bestimmten Microservice konzentrieren und muss sich keine Gedanken darüber machen, wie dieser mit anderen Microservices interagiert.

- Transparenz: Da eine Microservices-Architektur Dienste voneinander isoliert, können Engineering-Teams Anwendungen leichter untersuchen und lernen, wie sie zusammen funktionieren.

- verbesserte Zusammenarbeit: Ein nativer Cloud-Ansatz steigert die Produktivität und Kreativität und ermöglicht es den Entwicklungs- und Betriebsteams, mithilfe gemeinsamer Tools und Verfahren erfolgreicher zusammenzuarbeiten.

- Sicherheit und Compliance: Native Cloud-Anwendungen können die Sicherheitslage eines Unternehmens optimieren, indem sie Sicherheitsstandards in den Entwicklungsprozess integrieren. Sicherheitstests und automatisierte Compliance-Prüfungen gewährleisten, dass Anwendungen den gesetzlichen Standards entsprechen.

- reduzierte Ausfallzeiten: Containerorchestrierungsdienste wie Kubernetes, die in nativen Cloud-Anwendungen zum Einsatz kommen, ermöglichen es Unternehmen, Software-Updates mit minimalen bis gar keinen Ausfallzeiten bereitzustellen.

Herausforderungen bei der Entwicklung nativer Cloud-Anwendungen

Native Cloud-Anwendungen lösen einige der Probleme, die mit Cloud Computing einhergehen. Dennoch birgt die Migration in die Cloud zur Verbesserung der betrieblichen Effizienz eine Reihe von Herausforderungen.

Zu den wichtigsten Herausforderungen bei der Entwicklung nativer Cloud-Anwendungen gehören:

- Mangel an technischem Fachwissen: Unternehmen haben oft Schwierigkeiten, qualifizierte Fachkräfte zu finden, die sich gut mit nativen Cloud-Anwendungen und den damit verbundenen Praktiken auskennen. Die Entwicklung solcher Anwendungen erfordert einen großen Pool an Talenten mit Fachkenntnissen in den Bereichen Microservices, Containerisierung und Orchestrierungstechnologien.

- komplexe Infrastruktur: Native Cloud-Anwendungen verfügen über eine komplexe Infrastruktur und eine Vielzahl von Komponenten – Container, Microservices, Orchestrierungs-Tools und Servicemanagement –, die nahtlos zusammenarbeiten müssen. Daher erfordert die Entwicklung dieser Anwendungen zusätzliche Planung sowie Überwachung und Management, um optimale Leistung und Zuverlässigkeit zu gewährleisten.

- Sicherheitsbedenken: Aufgrund der verteilten Natur nativer Cloud-Anwendungen wird Sicherheit zu einem kritischen Thema. Daher müssen Unternehmen die Integration umfassender Sicherheitsmaßnahmen priorisieren und sich über potenzielle Sicherheitsbedrohungen in der Cloud-Umgebung auf dem Laufenden halten.

- Anbieterabhängigkeit: Wenn Unternehmen sich übermäßig auf bestimmte Cloud-Services oder -Anbieter verlassen, kann dies zu einer Anbieterabhängigkeit führen. Eine Anbieterabhängigkeit kann die Migration nativer Cloud-Anwendungen zu anderen Anbietern bei Bedarf erschweren. Die Einführung offener Standards und Multi-Cloud-Methoden ist jedoch ein wirksames Mittel, um die Risiken einer Anbieterabhängigkeit zu mindern.

- Einhaltung gesetzlicher Vorschriften: Die Einhaltung von Branchenvorschriften und -standards in einer nativen Cloud-Umgebung kann eine Herausforderung darstellen. Unternehmen müssen verschiedene Compliance-Anforderungen erfüllen und gleichzeitig die Agilität bewahren, die native Cloud-Anwendungen bieten.

- Kostenmanagement: Obwohl die native Cloud-Entwicklung zu Kosteneinsparungen führen kann, müssen Unternehmen bei der Überwachung und Verwaltung ihrer Cloud-Computing-Ressourcen besonders vorsichtig sein, da eine falsche Zuweisung von Ressourcen oder die Nichtbeachtung ungenutzter Ressourcen zu unvorhergesehenen Ausgaben führen kann.

Best Practices für die Entwicklung nativer Cloud-Anwendungen

Best Practices für das Design nativer Cloud-Anwendungen basieren auf dem DevOps-Prinzip der operativen Exzellenz. Die native Cloud-Architektur hat keine festen Regeln, und Unternehmen gehen die Entwicklung je nach den zu lösenden Geschäftsproblemen und der verwendeten Software unterschiedlich an.

Bei allen Designs nativer Cloud-Anwendungen sollte berücksichtigt werden, wie die Anwendung aufgebaut ist, wie die Leistung gemessen wird und wie Teams während des gesamten Lebenszyklus der Anwendung kontinuierliche Verbesserungen fördern. Die folgenden Phasen des Designs sind zu beachten:

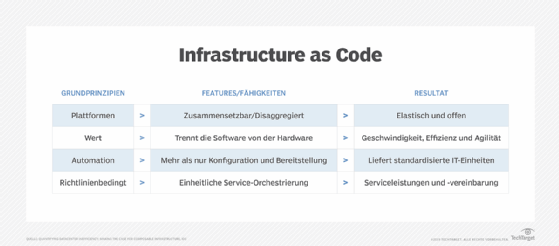

1. Automatisierung: Automatisierung ermöglicht die konsistente Bereitstellung von Cloud-Anwendungsumgebungen über mehrere Cloud-Anbieter hinweg. Mit Automatisierung wird Infrastructure as Code (IaC) verwendet, um Änderungen in einem Quellcode-Repository zu verfolgen.

2. Monitoring: Teams sollten die Entwicklungsumgebung sowie die Nutzung der Anwendung überwachen. Die Umgebung und die Anwendung sollten es einfach machen, alles von der unterstützenden Infrastruktur bis zur Anwendung zu überwachen.

3. Dokumentierung: Viele Teams sind an der Entwicklung nativer Cloud-Anwendungen beteiligt und haben nur begrenzte Einblicke in die Arbeit anderer Teams. Eine Dokumentation ist wichtig, um Änderungen zu verfolgen und zu sehen, wie jedes Team zur Anwendung beiträgt.

4. Ausführung von IaC: Unternehmen sollten IaC verwenden, um Infrastrukturressourcen durch versionierten, getesteten und automatisierten Code zu definieren und zu verwalten. Dieser Ansatz fördert eine unveränderliche Infrastruktur, die Änderungen durch die Erstellung neuer Instanzen anstelle der Änderung bestehender Instanzen ermöglicht.

5. Schrittweise Änderungen: Alle Änderungen an der Anwendung oder der zugrunde liegenden Architektur sollten schrittweise und reversibel sein. So können Teams aus Änderungen lernen und vermeiden, dauerhafte Fehler zu machen. Mit IaC können Entwickler Änderungen in einem Quell-Repository verfolgen.

6. Planung für einen Ausfall: Prozesse sollten so konzipiert sein, dass sie auch dann funktionieren, wenn in einer Cloud-Umgebung unvermeidlich Fehler auftreten. Dazu müssen Test-Frameworks eingerichtet werden, um Ausfälle zu simulieren und daraus zu lernen.

7. Anwendung von Best Practices für Sicherheit: Sicherheitsmaßnahmen sollten in jeder Phase des Entwicklungsprozesses für native Cloud-Anwendungen integriert werden. Dazu gehören sichere Codierungspraktiken sowie regelmäßige Schwachstellenanalysen.

Tools für die Entwicklung nativer Cloud-Anwendungen

Für jeden Entwicklungsprozess einer nativen Cloud-Anwendung werden mehrere Software-Tools verwendet. Zusammen bilden sie einen Entwicklungs-Stack.

Hier sind die Softwareprogramme, die in der Regel in einem nativen Cloud-Entwicklungs-Stack zu finden sind:

- Docker: Die Docker-Plattform ist Open Source. Sie erstellt, implementiert und verwaltet virtualisierte Anwendungscontainer unter Verwendung eines gemeinsamen Betriebssystems (OS). Sie isoliert Ressourcen, sodass mehrere Container dasselbe Betriebssystem ohne Konflikte nutzen können.

- GitLab CI/CD: Mit dieser CI/CD-Software können Benutzer Softwaretests und -bereitstellungen automatisieren. GitLab kann für Sicherheitsanalysen, statische Analysen und Unit-Tests verwendet werden.

- Istio: Istio ist ein Open-Source-Service-Mesh, der Microservices in nativen Cloud-Anwendungen verwaltet. Es bietet eine Ebene für Observability, Sicherheit und Traffic-Management, sodass Entwickler und Betriebsteams Interaktionen zwischen Microservices verwalten können.

- Kubernetes: Die Kubernetes-Plattform wird zur Verwaltung und Orchestrierung von Linux-Containern verwendet und legt fest, wie und wo die Container ausgeführt werden.

- Terraform: Terraform wurde für die Ausführung von IaC entwickelt und definiert Ressourcen als Code und wendet Versionskontrolle an, sodass Benutzer sehen können, wann und wo Ressourcen geändert wurden.

- Node.js: Diese JavaScript-Laufzeitumgebung ist nützlich für die Erstellung von Echtzeitanwendungen wie Chats, Newsfeeds und anderen Microservices. Node.js kann beispielsweise virtuelle Server erstellen und die Routen definieren, die Microservices mit externen APIs verbinden.

- OpenTelemetry: OpenTelemetry ist ein Tool für Observability und bietet Metriken, Tracing und Logs für einen guten Überblick auch über native Cloud-Anwendungen. Eine Unterstützung für viele Backend-Systeme wie Prometheus oder Grafana ist gegeben.

Die Zukunft nativer Cloud- Anwendungen

Native Cloud-Anwendungen haben in den letzten Jahren zunehmend Verbreitung gefunden und gelten als Zukunft der Softwareentwicklung. Laut einem Forschungsbericht von Precedence Research wurde der weltweite Markt für native Cloud-Plattformen im Jahr 2023 auf etwa 4,6 Milliarden US-Dollar geschätzt und soll bis 2033 rund 52,84 Milliarden US-Dollar erreichen.

Die Zukunft nativer Cloud-Anwendungen steht vor einem bedeutenden Wandel, der durch eine verstärkte Integration von künstlicher Intelligenz und maschinellem Lernen sowie durch neue Technologien wie Green Cloud und Quantencomputing gekennzeichnet ist.

Darüber hinaus werden solche Anwendungen weiterhin über verbesserte Sicherheitsmaßnahmen verfügen, die in CI/CD-Pipelines integriert sind, wobei der Schwerpunkt verstärkt auf Flexibilität und Skalierbarkeit in Multi-Cloud-Umgebungen liegt.