Timon - stock.adobe.com

Leitfaden für die Einführung von ChatGPT Enterprise

ChatGPT Enterprise stellt leistungsstarke generative KI-Funktionen für geschäftliche Anwendungsfälle zur Verfügung. Doch die Implementierung erfordert sorgfältige Planung.

Die Enterprise-Version von ChatGPT verspricht verbesserte Fähigkeiten für geschäftliche Anwendungsfälle. Doch wie man am besten eine Implementierungsstrategie plant, bleibt für viele Unternehmen unklar.

Da in vielen Organisationen bereits Diskussionen über generative KI geführt werden, stieß die Einführung von ChatGPT Enterprise Ende August 2023 branchenübergreifend auf großes Interesse. Die Ausweitung des KI-Tools auf sensible Geschäftsbereiche wirft jedoch neue Fragen zu Sicherheit, Compliance und Integration auf.

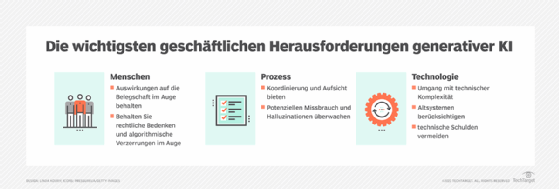

Um das Optimum aus der generativen KI herauszuholen und gleichzeitig die Risiken und Herausforderungen zu minimieren, müssen Unternehmen einen umfassenden Plan entwickeln, anstatt sich von dem Hype anstecken zu lassen.

Mit der Einführung von ChatGPT Enterprise bleibt ein strukturierter Implementierungsrahmen entscheidend für den Erfolg – genau wie bei früheren bahnbrechenden Technologien wie Software as a Service (SaaS) und Cloud Computing, die heute integrale Bestandteile vieler Unternehmen sind.

Funktionen von ChatGPT Enterprise

ChatGPT Enterprise ergänzt die Produktpalette von OpenAI neben der kostenlosen sowie den Plus-Versionen. Laut der Website von OpenAI plant das Unternehmen auch die Einführung einer ChatGPT Business-Ebene, die als Self-Service-Tool für kleinere Teams beschrieben wird.

Im Folgenden finden Sie einige der wichtigsten Funktionen, die ChatGPT Enterprise von den anderen Editionen unterscheiden:

- Sicherheit und Datenschutz auf Unternehmensniveau. In ChatGPT Enterprise werden Kunden-Prompts und Unternehmensdaten nicht zum Trainieren von OpenAI-Modellen verwendet. Die Daten werden außerdem im Ruhezustand (AES 256) und bei der Übertragung (TLS 1.2+) verschlüsselt, und die Software ist SOC 2-konform.

- Verwaltungsfunktionen für Unternehmensadministratoren. ChatGPT Enterprise bietet eine Verwaltungskonsole für die Massenverwaltung von Benutzern, Unterstützung für Single Sign-On und Domain-Verifizierung sowie ein Analyse-Dashboard für Einblicke in die Nutzung.

- Verbesserte Verfügbarkeit und Leistung. Benutzer von ChatGPT Enterprise können das GPT-4 Large Language Model (LLM) ohne Nutzungsbeschränkungen und mit höherer Geschwindigkeit ausführen – laut OpenAI bis zu doppelt so schnell.

- Datenanalytik und Entwicklungsfunktionen. ChatGPT Enterprise bietet unbegrenzten Zugriff auf die erweiterte Datenanalyse, früher bekannt als Code Interpreter, und kostenlose API-Credits für Unternehmensentwickler, die ChatGPT weiter anpassen möchten.

- Längere, detailliertere Prompts. ChatGPT Enterprise erweitert das Kontextfenster von ChatGPT auf 32.000 Token und vervierfacht damit die mögliche Länge der ersten Prompts, Dateien und Folgefragen.

- Wiederverwendbare Vorlagen und Workflows. ChatGPT Enterprise verspricht wiederverwendbare Chat-Vorlagen für die interne Zusammenarbeit und die Möglichkeit, benutzerdefinierte Workflows zu erstellen, die es den Benutzern ermöglichen, die Vorteile der Technologie zu nutzen, ohne dass sie fortgeschrittene Prompt-Kenntnisse benötigen.

OpenAI hat noch keine Roadmap für ChatGPT Enterprise veröffentlicht. Auf der Produktseite werden jedoch zukünftige Entwicklungen angedeutet, darunter die Möglichkeit, ChatGPT über eine sichere Integration mit anderen Unternehmensanwendungen mit Unternehmensdaten zu verknüpfen, leistungsfähigere Datenanalysefunktionen und Funktionen für bestimmte Aufgabenbereiche wie Marketing und Kunden-Support.

ChatGPT Enterprise einführen

Die Implementierung von ChatGPT auf Unternehmensebene macht Sicherheits- und Compliance-Probleme sichtbar, die mit jeder Einführung von generativer KI einhergehen. Entschärfen Sie diese Probleme, indem Sie den folgenden Implementierungsrahmen für ChatGPT Enterprise verwenden:

1. Implementierungsplan analysieren und definieren

Bei der Implementierung einer generativen KI-Anwendung von dem Umfang, den ChatGPT Enterprise verspricht, ist eine Analyse- und Definitionsphase unerlässlich. Einige wichtige Schritte in dieser Phase sind:

- Analysieren und definieren Sie die Anwendungsfälle des Unternehmens für ein LLM und bilden Sie die bestehende Unternehmensarchitektur ab.

- Bestimmen Sie alle branchenüblichen Compliance-Standards oder Sicherheitsprotokolle, die bei der Implementierung befolgt werden müssen, wie zum Beispiel EU-DSGVO oder HIPAA.

- Ermitteln Sie, wo sich die relevanten Unternehmensdaten befinden und wie ChatGPT Enterprise auf diese Daten zugreifen und sie nutzen wird.

- Rekrutieren Sie ein Pilotteam, das sowohl aus der IT- als auch aus der Geschäftsseite des Unternehmens stammt.

- Beziehen Sie das Cybersicherheitsteam während des gesamten Implementierungsprozesses ein, damit es sich zu allen Sicherheits- und Compliance-Fragen äußern kann.

2. Preise, Lizenzierung und Verträge prüfen

Rechnen Sie damit, dass sich die Lizenzierung und Verträge für ChatGPT Enterprise weiterentwickeln werden, auch für Unternehmen, die nicht zu den ersten Kunden gehören, die die Software implementieren. Nehmen Sie sich die zusätzliche Zeit, die Lizenz- und Vertragsbedingungen rechtlich gründlich zu prüfen, insbesondere wenn es um KI und die Sicherheit von Unternehmensdaten geht.

Für diejenigen, die sich fragen, wie viel ChatGPT Enterprise kostet, gibt es leider keine öffentlichen Preise. Stattdessen verweist das Unternehmen potenzielle Kunden an das Vertriebsteam. Der COO von OpenAI hat gesagt, dass das Unternehmen mit den Kunden an einem Preisplan arbeiten wird, der von den Bedürfnissen des Unternehmens abhängt.

Diese Situation ist zwar typisch für SaaS-Anbieter in der Anfangsphase, erfordert aber, dass die Unternehmen ihr eigenes Fachwissen über die Preisgestaltung mit einbringen. Dies könnte eine weitere Herausforderung darstellen, die von den internen Kenntnissen und Fähigkeiten abhängt. Außerdem besteht die Gefahr einer überraschenden Preiserhöhung zum Zeitpunkt der Vertragsverlängerung, wenn der Preis nicht bereits bei den ersten Verhandlungen festgelegt wurde.

3. Integration von ChatGPT Enterprise planen

Die Planung der Integration von ChatGPT in bestehende Anwendungen und Systeme ist ein entscheidender Schritt. Oberste Priorität sollte die API-Integration haben: Es muss festgelegt werden, wie ChatGPT Enterprise mit anderen Unternehmensanwendungen und Backend-Systemen über APIs kommunizieren soll. Es ist auch wichtig, den Prozess der Datenaufnahme zu definieren, der es ChatGPT Enterprise ermöglicht, die erforderlichen Daten sicher zu übernehmen und zu aktualisieren und dabei die Compliance-Standards einzuhalten. Das Unternehmen muss auch die Implementierung einer sicheren Authentifizierung planen, um sicherzustellen, dass nur autorisierte Benutzer auf ChatGPT Enterprise zugreifen können.

4. Das Modell anpassen und Personal schulen

Schulung hat bei der Implementierung einer generativen KI-Lösung für Unternehmen eine doppelte Bedeutung.

Erstens müssen Sie einige Zeit für die Feinabstimmung des LLM-Basismodells auf die Daten des Unternehmens aufwenden, um sicherzustellen, dass die Modellausgabe eher domänenspezifisch ist. Ein Nischenunternehmen muss ChatGPT beispielsweise auf die Terminologie trainieren, die für das Fachgebiet des Unternehmens spezifisch ist. Dieser Prozess umfasst häufig die Sammlung von Trainingsdaten, um eine gute Leistung zu gewährleisten.

Zweitens, während oder kurz nach der Modellanpassung und dem Training, ist es wichtig, Stakeholder und Endanwender auf das neue generative KI-System zu schulen. Die Schulung sollte sich einerseits an Manager und Führungskräfte richten, wobei der Schwerpunkt auf den geschäftlichen Gegebenheiten und dem Nutzenversprechen für generative KI liegen sollte, während sich andererseits die Schulung der Benutzer auf arbeitsbezogene Anwendungsfälle konzentrieren sollte. Planen Sie die Erstellung von Arbeitshilfen für den Wissenstransfer, um neuen und skeptischen Nutzern generativer KI den Einstieg zu erleichtern, und bereiten Sie das Service-Desk-Team auf die Bearbeitung von Anfragen zu ChatGPT Enterprise vor.

5. Ein Pilotprojekt oder einen Proof of Concept durchführen

Lassen Sie sich nicht vom Hype um generative KI anstecken. Wie bei jedem neuen Tool, ob von einem Start-up oder einem etablierten Unternehmensanbieter, führt kein Weg daran vorbei, ein Pilotprojekt oder einen Konzeptnachweis innerhalb des Unternehmens mit echten Benutzern durchzuführen.

Wenn Sie ein ChatGPT Enterprise-Pilotprojekt planen, sollten Sie beim Umfang kreativ werden. Beziehen Sie zum Beispiel Anwendungsfälle aus den Bereichen Marketing, Analyse und Vertrieb ein. Die Verknüpfung des Pilotprojekts mit Szenarien, die den Vertrieb effizienter machen können, sollte die Fragen der Befürworter und Gegner generativer KI gleichermaßen mit nachprüfbaren Fakten und Daten beantworten.

6. Live gehen

Die Arbeit der Teams in den vorangegangenen Phasen gipfelt darin, dass ChatGPT Enterprise im Unternehmen in Betrieb genommen wird. In dieser Phase werden die Projektbeteiligten und der Service-Desk damit beschäftigt sein, die Benutzer zu unterstützen, wenn das neue generative KI-Tool in die bestehenden Arbeitsabläufe integriert wird. Stellen Sie sicher, dass Feedback-Kanäle vorhanden sind, damit die Teams erfahren können, was bei der Einführung von generativer KI funktioniert und was nicht.

7. Kontinuierlich lernen

Kontinuierliches Lernen bekommt bei der Implementierung generativer KI im Unternehmen eine neue Bedeutung. Marketingbotschaften verblassen, während die Teams sich durch die eigentliche Arbeit graben. Alles in den Informationen, die OpenAI bisher zu ChatGPT Enterprise veröffentlicht hat, deuten darauf hin, dass mehr Lernen der Schlüssel zum Erfolg der Implementierung ist.