hamara - stock.adobe.com

Wie Microsoft Copilot mit den lokalen Daten umgeht

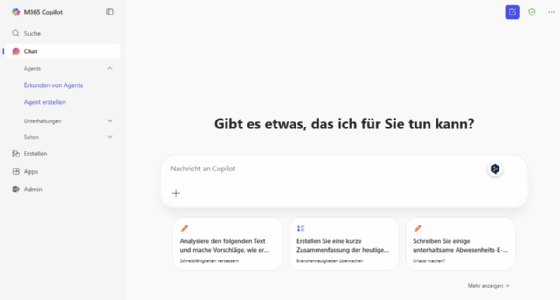

Microsoft integriert immer mehr KI-Funktionen in seine Office-Programme und Windows. Aber wie wird seitens Copilot mit den lokal gespeicherten Daten auf den Systemen umgegangen?

Neben verschiedenen KI-Diensten im Internet, nutzen immer mehr Anwender KI-Lösungen auch lokal auf ihrem PC oder Smartphone. Bekanntes Beispiel dafür ist Microsoft Copilot in verschiedenen Ausführungen. Microsoft integriert seinen KI-Assistenten Copilot in nahezu jeder App. Beim Einsatz lokal installierter KI-Lösungen, egal ob als Plug-in für Microsoft Office oder als eigenständige Software, spielt Datenschutz eine zentrale Rolle. Sobald personenbezogene Daten verarbeitet werden, greifen die Regeln der DSGVO. Das betrifft etwa Kundenlisten in Excel, Lebensläufe in Word oder entsprechende Gesprächsnotizen in Outlook.

Auch wenn die KI lokal läuft, muss klar sein, welche Daten verarbeitet, gespeichert oder ausgewertet werden. Besonders kritisch wird es, wenn KI-Systeme mittrainieren, also Inhalte aus früheren Eingaben dauerhaft analysieren oder abspeichern. Unternehmen müssen sicherstellen, dass keine Daten ungewollt weitergegeben werden, weder an andere Nutzer noch über eine versteckte Cloud-Verbindung an den Anbieter. Wichtig sind technisch-organisatorische Maßnahmen wie lokale Datenhaltung, verschlüsselte Zwischenspeicherung und klare Löschkonzepte. Vor dem Einsatz von KI-Diensten ist zudem eine Datenschutz-Folgenabschätzung durchzuführen. Es sollte dokumentiert werden, welche Art von Daten die KI verarbeitet und zu welchem Zweck.

Datenschutz bei lokal installierten KI-Lösungen: Chancen und Fallstricke

Wer Copilot lokal in Office-Anwendungen wie Word oder Excel nutzt, arbeitet formal nicht mit einer Cloud-basierten KI, sondern mit einem lokal eingebetteten Frontend, das jedoch im Hintergrund stark auf zentrale Dienste zurückgreift. Auch wenn die KI im jeweiligen Programm erscheint, laufen viele Anfragen über Microsoft Graph und die zugrunde liegenden LLMs (Large Language Models) über zentrale Microsoft-Infrastrukturen, sofern keine strikte Netzwerktrennung oder Endpoint-Konfiguration dagegensteht. Datenschutzrechtlich entscheidend ist also nicht die lokale Installation der Software, sondern wo und wie Daten verarbeitet werden.

Eine bloße Offline-Nutzung existiert nicht bei Copilot nicht. Auch lokal gestartete Copilot-Instanzen senden Prompts und Kontextinformationen an Server, um darauf zu antworten. Unternehmen, die Office lokal installieren und glauben, damit unter der DSGVO auf der sicheren Seite zu sein, übersehen diesen zentralen Punkt. Erst durch gezielte Maßnahmen, etwa über Conditional Access, Endpoint DLP, kontrollierte Berechtigungszonen in Microsoft Purview oder eine explizite Bereitstellung von Microsoft 365 Copilot mit Enterprise Data Residency, lässt sich das Risiko kontrollieren.

Selbstentwickelte KI-Lösungen, etwa basierend auf LLMs wie LLaMA oder Mistral, ermöglichen mehr Autonomie. Werden sie vollständig auf eigenen Servern betrieben, entfällt der Transfer in Drittstaaten. Doch dann liegt auch die gesamte Verantwortung für Logging, Protokollierung, Löschfristen und Transparenz auf Seiten des Betreibers. Ohne klare Auftragsverarbeitungsverträge und technische Maßnahmen zur Datenminimierung entstehen neue Risiken, selbst bei vollständiger lokaler Kontrolle. Entscheidend bleibt die Dokumentation. Wer welche Daten wie verarbeitet, muss jederzeit nachvollziehbar sein. Der bloße Einsatz einer lokalen Anwendung schützt nicht automatisch vor DSGVO-Verstößen, er verschiebt nur die Verantwortung.

Copilot und Dokumente in Microsoft Office

Microsoft hat Copilot tief mit der Office-Welt verflochten. Word, Excel, Outlook, PowerPoint, Teams, alles hat inzwischen seinen Platz in der Einbindung der generativen Assistenten gefunden. Copilot aus der Cloud weiß wiederum nur, was Microsoft 365 ihm zeigt. Die Grenzen verwischen aber, weil immer mehr Unternehmen Daten aus der Cloud auch lokal einbinden.

Die Grundlage aller Copilot-Funktionen ist ein Cloud-Modell, das ausschließlich Daten aus dem Microsoft Graph bezieht. Dieser Index kennt Mails, Kalendereinträge, OneDrive-Inhalte, SharePoint-Bibliotheken, Teams-Chats. Kein Zugriff auf lokale Dateipfade, keine Verbindung zu SMB-Freigaben, keine Sicht auf Netzlaufwerke. Word-Dokumente auf einem Windows-Desktop, Excel-Dateien auf dem Netzshare oder PDF-Sammlungen auf einem NAS sind generell nicht angebunden. Auf diese Daten kann aber der lokale Copilot in Windows 11 zugreifen.

Outlook und Teams haben durch ihre engere Integration mit der Cloud Zugriff auf E-Mails, Besprechungsnotizen, OneDrive-Links. In Word, Excel und PowerPoint dagegen greift Copilot auf Inhalte zurück, die explizit über SharePoint oder OneDrive referenziert werden. Hier können aber ebenfalls lokal gespeicherte Dateien als E-Mail-Anhang oder zum Backup gespeichert werden.

Zwar erlaubt Copilot Studio das Einbinden eigener Inhalte über Knowledge Sources. Doch auch das funktioniert vor allem über Uploads. Lokale Dateien müssen zuerst manuell in das Studio transferiert werden. Eine automatische Indexierung eines Netzlaufwerks, eine Integration lokaler Archive oder das Durchsuchen einer Dateifreigabe ist zunächst nicht vorgesehen. Die Studio-Komponente funktioniert wie ein abgespeckter RAG-Stack.

Copilot kann auf lokale Dateifreigaben zugreifen

Microsoft öffnet den Copilot-Zugriff auf lokale Dateiserver. Wer Copilot nutzen will, muss seine Daten nicht zwingend in Microsoft 365 oder OneDrive speichern. Stattdessen lassen sich lokale Dateifreigaben über einen speziellen Graph-Connector anbinden, der im Azure-Portal eingerichtet wird. Die Einrichtung erfordert neben einem installierten Agenten auf dem Fileserver auch eine Auswahl der freizugebenden Ordner sowie eine Indizierung durch Microsoft Search. NTFS-Berechtigungen bleiben dabei erhalten, nur wer Zugriff auf bestimmte Dateien hat, bekommt diese auch über den KI-Assistenten angeboten. Der Connector synchronisiert im 15-Minuten-Takt, unterstützt Millionen von Dateien und funktioniert mit allen gängigen Office- und Textformaten. Voraussetzung sind eine Copilot Studio Lizenz und ein konfigurierter Agent, der lokal verankertes Wissen für Copilot verfügbar macht, unabhängig von Cloud-Speicher oder SharePoint.