sabida - stock.adobe.com

Wie MCP KI-Agenten zur Angriffsfläche für Kriminelle macht

KI-Agenten, die nicht nur Informationen teilen, sondern autonom Aufgaben ausführen, erzeugen eine neue Angriffsfläche. Das Model Context Protocol erfordert eine eigene Sicherheit.

Künstliche Intelligenz hat dem Wettrennen zwischen Cyberkriminellen und IT-Abwehr eine neue Dynamik gegeben. KI-Technologien entwickeln sich zurzeit deutlich schneller als die dafür notwendigen robusten Sicherheitstechnologien und Leitplanken. Auch beim MCP-Protokoll, zu dessen Aufgaben Interoperabilität und eine umfassende Funktionalität zählen, hat Sicherheit keine Priorität und wird nicht per se mitbedacht. Risiken sind damit vorhersehbar.

Das von Antropic Ende 2024 eingeführte Model Context Protocol (MCP) stellt eine standardisierte Kommunikationsschnittstelle für KI-Anwendungen dar – von der Bedeutung her vergleichbar mit einem USB-C in der IT. Der offene Standard des Protokolls soll vereinfachen, wie Large Language Models (LLM) ihre Informationen oder Tools aus dem Internet oder von anderen Systemen beziehen. Ein einzelner, aber weit verbreiteter Port ist jedoch ein lohnendes Ziel von Cyberkriminellen.

Verbindung schafft Angriffsflächen

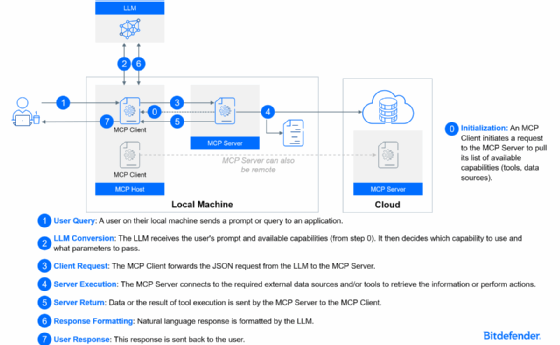

Die Wege des MCP-gesteuerten Informationsflusses bieten eine große Angriffsfläche für Attacken. Die Konnektivität zwischen den verschiedenen Instanzen, einer LLM und dem Kunden soll daher hier dargelegt werden.

Das MCP basiert auf einem Client-Server-Modell, in dem ein MCP-Client mit einem einzelnen MCP-Server verbunden ist. Ein LLM kommuniziert dabei niemals direkt mit einem MCP-Server oder mit externen Webseiten. Stattdessen vermittelt der MCP Host zwischen dem LLM und dem Client. Der MCP-Client verwaltet wiederum eine Eins-zu-eins-Verbindung mit dem MCP-Server.

Der MCP-Client erkennt bei seiner Initialisierung zunächst die Fähigkeiten des MCP-Servers. Der Host präsentiert dem LLM die verfügbaren Tools. Sobald der Host einen Prompt des Nutzers erhält und das LLM erkennt, dass externe Interaktion nötig ist, agiert das LLM als Schlussfolgerungsmaschine (reasoner). Es analysiert den Input und wählt die geeigneten Tools und Argumente aus. Der Host instruiert darauf basierend den Client, um einen strukturierten JSON-RPC Call an seinen MCP-Server aufzubauen und zu versenden.

Der Client empfängt den maschinenlesbaren Output des Servers und leitet ihn wieder an den Host. Von da gelangt er zum LLM. Nach weiteren KI-Denkprozessen und Synthesen präsentiert das LLM seine Antwort an den Nutzer in natürlicher Sprache.

Berufsrisiken der Agenten

Das MCP-Protokoll zeichnet sich durch seine Flexibilität aus, aber gerade hieraus entstehen Konflikte mit traditionellen Sicherheitsmodellen. Fünf Gefahrenpunkte sollten CISOs und die Teams der IT-Sicherheit auf jeden Fall berücksichtigen:

1. Sich für ein sicheres Ökosystem entscheiden

Viele Tools der Cybersicherheit haben Probleme, mit der sprunghaften Innovationsdynamik der KI schrittzuhalten. Ergebnis ist ein fragmentiertes und inkonsistentes Ökosystem, welches kaum auf standardisierten Prinzipien für Cybersicherheit basiert. Zum Beispiel nutzen nur manche Implementierungen eine robuste Authentifizierung für Remote-MCP-Server. In der Regel ist die Konnektivität zwischen MCP Host (Client) und LLM am sichersten, weil das Kommunikationsprotokoll die Authentifizierung zwingend vorschreibt. Die größten Risiken bergen dagegen Verbindungen zwischen Client und Server. MCP schlägt hier die die Authentifizierung und Sicherheitsrichtlinien nur vor. Es ist aber Aufgabe des Nutzers, diese einzusetzen und durchzusetzen.

2. Supply Chain für Kontexte und Tools

Angreifer können den Austausch von Daten und Tools für ihre Zwecke nutzen. Ein MCP Server agiert als Zwischenglied, zieht Daten aus verschiedenen Quellen heran oder führt Funktionen aus einem vom Nutzer bereitgestellten PDF-Dokument aus. Ein bösartiges oder kompromittiertes Glied in der Kette kann manipulierte oder schädlichen Inhalte liefern: Ganz einfach, indem eine Datenquelle einen unsichtbaren Unicode-Angriff übermittelt. Oder hoch komplex, wenn ein harmloses Tool um eine schädliche Funktion erweitert wird. Ohne formale Bewilligung und Validierung von Code riskieren Unternehmen neue Sicherheitslücken.

3. Zu viele Privilegien

MCP-Server – und damit die Agenten – verfügen häufig über zu viele Privilegien mit langen Laufzeiten und ohne Einschränkungen. Eine zusätzliche Gefahr erwächst, wenn ein Server mit umfangreichen Privilegien Aktionen für einen Nutzer mit weniger Rechten durchführt. Das MCP-Protokoll übermittelt nämlich nicht von sich aus die Kontextinformationen zu den Nutzern vom Host auf den Server. Der Server kann daher nicht zwischen Nutzern und ihren Kompetenzen unterscheiden. Unter Umständen gewährt er allen dieselben Zugangsrechte, was die Gefahr erhöht, dass Nutzer oder Angreifer Daten exfiltrieren oder Aktionen durchführen, die ihnen nicht zustehen. Hacker müssen nicht in die Systeme eindringen, sondern lediglich den legitimen KI-Agenten mit seinen überprivilegierten Tokens nutzen.

„Unternehmen werden diese Sicherheitsrisiken nicht mehr lange ignorieren können. Wichtige Security-Hinweise finden sich bereits in den offiziellen MCP-Best-Practices für Sicherheit. IT-Sicherheitsverantwortliche sollten proaktive Maßnahmen für eine sichere MCP-Infrastruktur ergreifen.“

Martin Zugec, Bitdefender

4. Injection-Angriffe

Prompt Injection ist eine vieldiskutierte Gefahr. Das agentische Modell ermöglicht anspruchsvollere und gefährlichere Spielarten. Beim „context poisoining“ manipulieren Angreifer subtil Dokument- oder Datenquellen, um das Verhalten des Agenten zu verändern. Eine Tool-Injektion erlaubt den Eindringlingen, die Anweisungen für den Agenten zu manipulieren, ihn zur Ausführung schadhafter Aktionen zu veranlassen oder externe Ressourcen zu kompromittieren.

5. Mängel in Audit Logging und Nachverfolgbarkeit

Intransparenz sorgt nicht nur für Misstrauen gegenüber KI-Output, sondern verwischt auch die Spuren der Angreifer. Fehler oder Exploits eines Agenten sind nur schwer nachvollziehbar. Es fehlt bereits an einem robusten und standardisierten Weg, um die gesamte Gedankenkette der KI zu erfassen: von der ersten Anfrage des Nutzers über die Entscheidung der KI für ein bestimmtes Tool bis hin zur finalen Aktion des MCP-Servers. Woher kamen die Daten? Weshalb entschied sich ein Agent für dieses Tool? Was war der exakte Status der Umgebung, als eine Aktion durchgeführt wurde. So ist eine schwerwiegende Wahrnehmungslücke in der Compliance und hinsichtlich der Verantwortlichkeit gegeben. Zu erwarten ist, dass Regulatorien die Unternehmen, die im Zweifelsfall für ihren Einsatz von KI-Agenten verantwortlich sind, in die Pflicht nehmen. Schon jetzt dürften die Probleme in der Nachverfolgung die Compliance etwa mit der DSGVO n Frage stellen.

Unternehmen werden diese Sicherheitsrisiken nicht mehr lange ignorieren können. Wichtige Security-Hinweise finden sich bereits in den offiziellen MCP Best Practices für Sicherheit. IT-Sicherheitsverantwortliche sollten proaktive Maßnahmen für eine sichere MCP-Infrastruktur ergreifen. Dazu gehören Approval-Prozesse für MCP-Server oder der Aufbau eines Pools für rein interne MCP-Server und der Ausschluss von Servern aus öffentlichen Quellen. Ebenso wichtig ist es, alle Inputs für eine KI zu überprüfen und zu validieren. Schnittstellen für eine agentische KI sollten nur notwendige Privilegien erhalten. Monitoring auf auffälliges Verhalten ist gerade beim Einsatz einer autonomen KI wichtig. Letzten Endes sollte der Mensch immer das letzte Wort haben – in jedem Fall bei wichtigen und sicherheitsrelevanteren Aktionen.

Die Autoren sind für den Inhalt und die Richtigkeit ihrer Beiträge selbst verantwortlich. Die dargelegten Meinungen geben die Ansichten der Autoren wieder.