beebright - stock.adobe.com

Per verhaltensbasierter Biometrie Bots identifizieren

Böswillige Bots imitieren menschliches Verhalten, um Legitimität vorzutäuschen. Die Bot-Technologie wird dabei immer besser, aber auch die Erkennung ist weit fortgeschritten.

Mehr als die Hälfte des Internet-Traffics wird durch Bots verursacht, wie der Bot Traffic Report von Imperva bei stark steigender Tendenz bereits 2016 belegen konnte. Glücklicherweise ist nicht jede Form des Netzwerkverkehrs bösartig, nur weil er von einem Bot verursacht wird.

Es gibt viele gute Bots, die im Internet aktiv sind. Die Herausforderung ist allerdings, die guten von den bösartigen Bots zu unterscheiden und die schädlichen Bots von den menschlichen Nutzern zu trennen. Durch die ständige Verbesserung der Bot-Technologie wird dies immer schwieriger.

Gute und böswillige Bots

Den meisten Traffic im Internet erzeugen hilfreiche Bots, die man in vier Gruppen unterteilen kann: Die erste Form überträgt beispielsweise Daten zwischen den Anwendungen eines bestimmten sozialen Netzwerks, um den Inhalt der Newsfeeds auf allen Web- und Mobile-Applikationen zu aktualisieren. Ein weiterer gängiger Typ stammt von Suchmaschinen, die Webseiten untersuchen, um sie in den Suchergebnissen zu platzieren. Crawler bilden die dritte Art guter und erwünschter Bots, die das Internet durchsuchen und verschiedene Daten sammeln, beispielsweise für Marketingzwecke. Zur vierten Gruppe gehören jene, die Webseiten kontrollieren und sicherstellen, dass sie so funktionieren, wie sie sollten.

Allerdings ist bei steigender Tendenz mittlerweile die Hälfte des Bot-Verkehrs bösartig. Die Auswahl reicht von Scrapern, die unautorisierte Daten extrahieren, über Spammer, die Diskussionsseiten mit Textmüll, Links oder Werbung fluten, bis hin zu Scavengern, die nach Systemen und Webseiten mit Schwachstellen suchen, die sie infizieren können. Am häufigsten sind allerdings jene schädlichen Bots, die sich als Menschen ausgeben, um Sicherheitslösungen anzugreifen, neue Accounts auf Webseiten wie Online-Shops anzulegen oder Webseiten unautorisiert zu durchsuchen. Sie bilden die Front der DDoS-Angriffe. Mit dem Fortschritt der Technologie werden auch die bösartigen Bots und ihre menschliche Imitation immer besser, weshalb es für die Sicherheitssysteme deutlich schwieriger wird, sie zu erkennen. Das führt zu einem Dilemma in der Cybersicherheit, Sicherheitsfunktionen so zu gestalten, dass sie unerwünschte Bots zuverlässig erkennen, aber die menschlichen Benutzer nicht mit zu vielen lästigen Sicherheitsabfragen konfrontieren.

Mensch und Maschine müssen unterschieden werden

Die Trennung zwischen den schlechten Bots, die menschliches Verhalten imitieren, von den menschlichen Nutzern ist seit Langem eine Herausforderung für die Besitzer von Webseiten. Während Bots so programmiert werden können, dass sie bei einigen Aufgaben viel besser agieren als Menschen, hat sich schnell gezeigt, dass Bots bei einigen für Menschen trivialen Dingen schnell an ihre Grenzen stoßen. Diese Erkenntnis ist die Grundlage für Captchas zur Verifikation des Nutzers. Zwar lässt sich mit einem Captcha ein Mensch von einem Bot trennen, aber im Alltag sind sie für den Benutzer aufdringlich und mittlerweile auch keine zuverlässige Methode mehr.

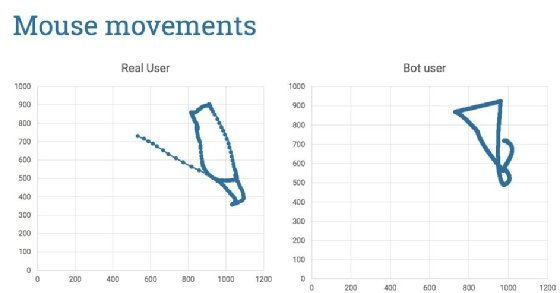

Aufgrund ihrer mechanischen Natur sind Bots tendenziell berechenbarer als Menschen. Vergleicht man zum Beispiel einen menschlichen Akteur mit einem Bot anhand der Mausbewegung, kann man eine ganze Reihe von Unterschieden feststellen: Selbst, wenn ein Bot so programmiert ist, dass er sich dem bloßen Auge nach wie ein Mensch verhält, gibt seine technische Natur die Schwachstelle vor: Menschen nehmen sich mehr Zeit, ihr Verhalten ist unberechenbarer und wechselt häufig. Diese Muster können selbst die besten Bots nicht abbilden.

Neben den Mausbewegungen bietet sich auch eine Analyse des Tipprhythmus als Merkmal an, das Mensch und Maschine zuverlässig unterscheidet. Wie bei den Mausbewegungen lässt sich das Problem auf den Punkt bringen: Bots sind schlecht darin, sich unvollkommen oder überraschend zu verhalten. Die menschliche Tippgeschwindigkeit reicht in der Regel von null bis über 150 Wörter pro Minute und selbst die erfahrensten Schreiber weisen Unvollkommenheiten auf.

Bot-Bekämpfung durch verhaltensbasierte Biometrie

Verhaltensbiometrie, die auf diesen menschlichen Schwankungen aufbaut, kann Bots heutzutage problemlos erkennen. Für den Entwickler eines Bots ist es eine viel schwierigere Aufgabe, das menschliche Verhalten während einer kompletten Sitzung vollständig nachzuahmen, als den Bot zu befähigen, eine konkrete Aufgabe, beispielsweise ein Captcha, zu erledigen. Bereits vor sechs Jahren war es möglich, betrügerische Bots innerhalb von drei bis vier Minuten anhand der Mausdaten zu erkennen.

„Das Internet ist voller digitaler Maschinen, die einen Großteil des Internet-Traffics ausmachen. Problematisch wird das bei böswilligen Bots, die das Verhalten von Menschen imitieren, um Legitimität vorzutäuschen.“

Sebastian Mayer, BehavioSec

Mittlerweile können Bots im Sekundenbereich erkannt werden, weil etwa drei Tastenanschläge genügen, um einen Benutzer bei der Eingabe von Benutzername und Passwort beim Login als menschlich zu identifizieren und Bots den Zugriff zu verweigern. Die Verhaltensbasierte Biometrie bietet sich daher besonders für alle Online-Konten an, die ein häufiges Ziel von Angreifern sind: Online-Bank-Accounts, Konten im e-Commerce, E-Mail-Postfächer, Geschäftskonten und viele andere.

Ein wichtiger Vorteil bei der Analyse von Tippverhalten und Mausbewegungen ist die kontinuierliche Identifizierung während der gesamten Nutzungsdauer eines Geräts, das bedeutet, die Sicherheitsüberprüfung hört nicht mit dem Login auf. Stattdessen wird während der gesamten Session überprüft, ob es sich immer noch um einen Menschen handelt oder ein digitaler Roboter die Sitzung übernommen hat.

Fazit

Das Internet ist voller digitaler Maschinen, die einen Großteil des Internet-Traffics ausmachen. Problematisch wird das bei böswilligen Bots, die das Verhalten von Menschen imitieren, um Legitimität vorzutäuschen. Damit richten sie immensen Schaden an.

Die Bot-Erkennung ist inzwischen eine alte Kunst und hat große Fortschritte erzielt. Mittlerweile genügen bereits drei Tastenanschläge, um einen Menschen von einer Maschine zu unterscheiden. Die vielfältigen Einsatzmöglichkeiten sind nicht nur Online-Konten zu schützen, sondern auch direkt auf Geräten implementiert zu werden, um sicherzustellen, dass nur menschliche Benutzer Zugriff auf Daten und Befehle haben. Böswillige Skripte und Bots können so ohne zusätzliche Komplexität für den Benutzer stark eingedämmt und Konten sowie Geräte deutlich sicherer gemacht werden.

Über den Autor:

Sebastian Mayer ist Director Sales DACH/CEE bei BehavioSec.

Folgen Sie SearchSecurity.de auch auf Twitter, Google+, Xing und Facebook!