metamorworks - stock.adobe.com

IA ética, el nuevo imperativo empresarial según IBM

La adopción de inteligencia artificial ética se ha convertido en un factor clave para la competitividad empresarial, según un estudio del IBM Institute for Business Value. No obstante, persisten barreras como la escasez de talento especializado, la falta de explicabilidad y la tensión entre objetivos de negocio y valores éticos.

Integrar el componente de ética a la inteligencia artificial (IA) ha llamado la atención de las organizaciones, que han estado analizando los retos y oportunidades que esto plantea. Y es que, ante el rápido avance e implementación de la IA en los entornos empresariales, surge la necesidad de construir casos de negocio robustos que no sólo justifiquen la inversión e implementación, sino que también contengan marcos claros de su alcance y utilización.

El estudio “Retorno de la inversión (ROI) de la IA ética” del IBM Institute for Business Value (IBM IBV), realizado en colaboración con el Notre Dame–IBM Tech Ethics Lab, encuestó a más de 900 ejecutivos de 19 países, incluido México, que representan 19 funciones corporativas y 18 industrias, con el objetivo de comprender cómo están abordando las organizaciones la IA desde una perspectiva ética.

De acuerdo con Jorge Paz, especialista en IA de IBM México, el estudio profundiza en cómo las compañías, tanto mexicanas como globales, implementan prácticas de IA ética, sus motivaciones y el impacto generado en los resultados del negocio. “El estudio se enfoca en cómo optimizar el beneficio de la IA al tiempo de reducir los riesgos y los resultados adversos, enfatizando en aspectos como responsabilidad, privacidad de datos, equidad, explicabilidad, solidez, transparencia, inclusión y alineación con los valores empresariales”, indicó.

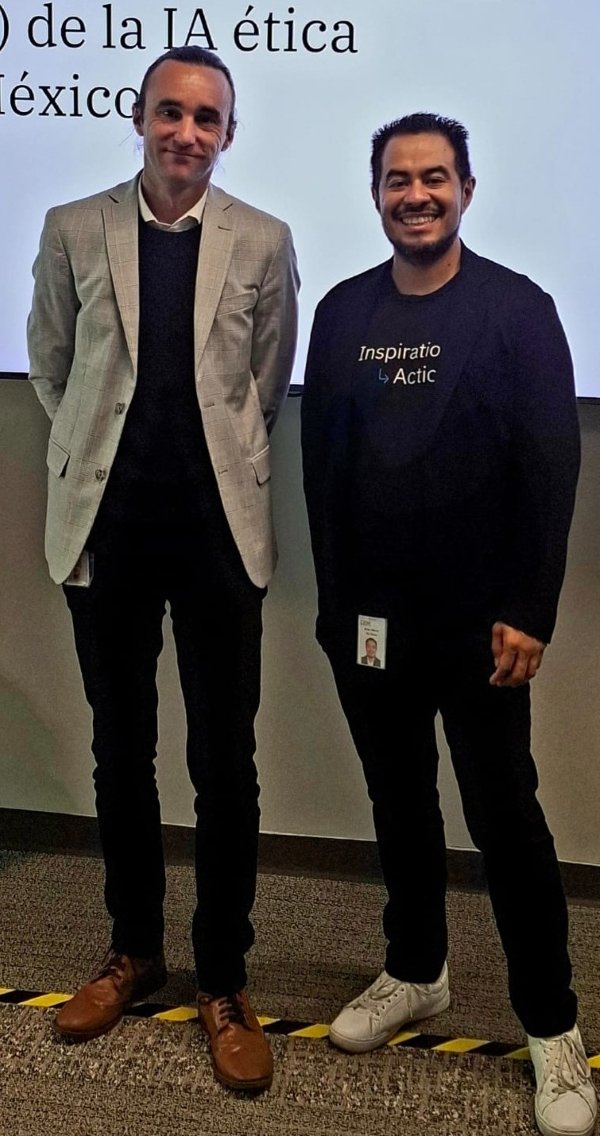

De izq. a der.: Manuel O’Brien, director de Relac. Guber

De izq. a der.: Manuel O’Brien, director de Relac. Guber

namentales y Políticas, IBM México, Chile y Costa Rica,

y Jorge Paz, especialista en IA, IBM México.

Ética y valor, una combinación que impulsa resultados

El estudio revela que las organizaciones que más invierten en IA ética obtienen mayores beneficios operativos, un retorno de inversión (ROI) más sólido y una ventaja competitiva medible. En México, esta visión está ganando terreno.

Uno de los principales hallazgos es que los ejecutivos mexicanos planean incrementar casi al doble el gasto en IA ética, del 5,3 % del presupuesto total en 2023, al 10,7 % en 2026. Además, 53 % afirma que estas prácticas han incrementado la confianza del cliente y mejorado la calidad de los productos.

Entre los beneficios más citados destacan:

- mayor confianza (67 %),

- fortalecimiento de la reputación (58 %) y

- mitigación de riesgos reputacionales (58 %).

Los indicadores de negocio también muestran mejoras: satisfacción y retención de clientes (25 %), prevención de incidentes vinculados con IA ética (23 %), adopción de IA (17 %) y mayor eficiencia (15 %).

“Se buscó con el estudio identificar los objetivos de las empresas de trabajar con IA, y uno de ellos fue diferenciarse en el mercado”, subrayó Paz.

Las organizaciones que integran la confianza como eje central capturan más valor empresarial de sus inversiones, obteniendo beneficios financieros directos, una cultura organizacional más sólida y capacidades que generan ventajas sostenibles.

Límites y sesgos

A pesar del creciente interés, muchas organizaciones aún se encuentran atrapadas entre las buenas intenciones y una ejecución limitada que dificulta alcanzar un ROI significativo. Solo un tercio de los ejecutivos encuestados a nivel global afirma que sus compañías aplican herramientas específicas para garantizar ética en la IA.

Más de la mitad señala la confianza, el sesgo y la falta de explicabilidad como barreras para su adopción. Sin embargo, los líderes no pueden permitirse la inacción, especialmente cuando los beneficios están claramente identificados. La llegada de los agentes de IA, caracterizados por mayor autonomía y complejidad, refuerza la urgencia de enfrentar estos retos.

En México, las principales barreras identificadas incluyen:

- la tensión entre los objetivos de negocio y los valores éticos (64 %);

- la escasez de talento calificado (64 %) y la dificultad de capacitar a gran escala (53 %);

- las limitaciones financieras (60 %);

- las preocupaciones éticas y dificultades para generar confianza interna (49 %);

- la falta de explicabilidad, sesgos o falta de confianza como obstáculos para la adopción (49 %).

Actualmente, solo 36 % de las organizaciones aplica herramientas básicas de IA ética, en tanto 44 % ha integrado prácticas de IA ética en su estrategia. Además, 71 % considera que la IA agéntica requerirá lineamientos éticos más estrictos y 64 % cree necesario replantear los marcos actuales, a medida que la IA gane autonomía.

Gobernanza transversal

La gobernanza de IA opera en dos niveles: liderazgo ejecutivo y funciones operativas. Para ser efectiva, la ética debe cruzar y conectar ambos, aunque esto no siempre sucede. El estudio muestra que, aunque las responsabilidades suelen recaer en posiciones de liderazgo, la toma de decisiones éticas está distribuida entre múltiples equipos.

“Lo importante es que se integre la IA a los flujos de trabajo. No es sólo tarea de los directivos, sino de todas las áreas que pueden beneficiarse de ésta. Y, por supuesto, para asegurarse de que la IA se esté usando de forma correcta y evitar la fuga de datos y el Shadow AI”, añadió Paz.

A nivel global, 53 % de las organizaciones considera que sus estructuras de gobernanza son ineficaces, probablemente por intentar regular una capacidad transversal desde un único rol. Los modelos más exitosos combinan supervisión a nivel directivo con colaboración multifuncional, integrando la ética en la operación diaria y no como una restricción externa.

La lógica de la regulación: riesgos, no tecnología

Para Manuel O’Brien, director de Relaciones Gubernamentales y Políticas de IBM México, Chile y Costa Rica, los gobiernos enfrentan el desafío de determinar qué regular en materia de IA. Aunque se observa un auge regulatorio mundial, advierte que “es importante no regular por regular, ni por cuestión de moda”.

En México aún no existe una regulación comparable a la de regiones como la Unión Europea; sin embargo, definir una estrategia es vital. Las razones para regular incluyen corregir fallas de mercado, proteger derechos humanos, mitigar daños económicos y asegurar transparencia para el usuario.

El enfoque adecuado, según O’Brien, es regular el riesgo, no la tecnología. Cada aplicación de IA es distinta y solo los casos de alto riesgo deben estar sujetos a regulaciones más estrictas. Asimismo, los desarrolladores e implementadores deben asumir responsabilidad proporcional al rol que desempeñan, procurando un equilibrio entre innovación y responsabilidad.

También enfatiza la importancia de evitar regímenes de licencias que limiten la innovación abierta. “Esto permite un sistema que no tenga licencias y que las pymes puedan utilizar y crear IA sin tener que invertir en sistemas de licencias”, afirmó. Añadió que uno de los grandes retos está en democratizar el acceso mediante capacitación y desarrollo de talento.

La ética en la inteligencia artificial se ha ido convirtiendo en un diferenciador estratégico. El estudio de IBM muestra que las organizaciones que invierten en prácticas responsables no sólo reducen riesgos, sino que obtienen beneficios medibles en confianza, reputación y desempeño.

Sin embargo, aún existen brechas importantes en talento, gobernanza y claridad regulatoria. A medida que la IA adquiere mayor autonómica, es vital avanzar hacia modelos éticos, colaborativos y basados en el riesgo, los cuales serán clave para construir un futuro empresarial más confiable, innovador y sostenible.

[FOTOS]

Manuel O’Brien, director de Relaciones Gubernamentales y Políticas de IBM México, Chile y Costa Rica (izquierda) y Jorge Paz, especialista en IA de IBM México (derecha).